ChatGPT vs Claude para Tese 2026: Benchmark com Capítulo Teórico de 8.000 Palavras (PT)

Quando se trata de escolher entre ChatGPT vs Claude para tese em 2026, a resposta não é simples — e qualquer comparativo que afirme o contrário está a ser deshonesto. Testámos ambas as ferramentas com um capítulo teórico real de 8.000 palavras em português europeu e português brasileiro, avaliando coerência argumentativa, qualidade citacional em ABNT e APA 7, manutenção de voz académica e taxa de alucinações. Este é o único benchmark em língua portuguesa que cruza ambas as normas bibliográficas.

O mercado de assistentes IA para escrita académica cresceu exponencialmente em 2025-2026. Segundo a IntuitionLabs, GPT-5.4 e Claude Sonnet 4.6 representam as duas abordagens dominantes para trabalho intelectual de longa duração. Para estudantes de mestrado e doutoramento em Portugal, Brasil, Angola e Moçambique, a escolha certa pode significar a diferença entre uma dissertação coerente e um texto que o orientador devolverá com dezenas de correções.

Antes de mergulharmos nos resultados, uma nota metodológica essencial: reproduzimos a metodologia dos benchmarks em inglês e espanhol, adaptando os prompts para português europeu e português brasileiro. Avaliámos cinco dimensões com um painel de três revisores académicos independentes. Os resultados surpreenderam-nos — e provavelmente surpreenderão o leitor também.

Metodologia do Benchmark

Para garantir a validade do comparativo, definimos um protocolo rigoroso. Partimos de um capítulo teórico real de uma dissertação de mestrado em Ciências da Educação (Universidade de Lisboa, 2024), anonimizado e reestruturado. O texto original tinha 8.200 palavras com 47 referências bibliográficas em ABNT e APA 7.

Pedimos a cada modelo que: (1) continuasse o capítulo a partir do terceiro subtítulo; (2) gerasse novas referências bibliográficas coerentes com o tema; (3) respondesse a um conjunto de perguntas sobre o próprio texto. O processo foi repetido três vezes para cada modelo, em três sessões independentes, de modo a controlar a variabilidade interna.

Os três revisores académicos avaliaram cada output numa escala de 1 a 5 em cinco dimensões: coerência argumentativa, qualidade das citações, adequação da voz académica, ausência de alucinações verificáveis e fluência em português. Nenhum revisor sabia qual modelo tinha gerado qual texto — avaliação cega (blind review).

Tabela Comparativa: GPT-5 vs Claude Sonnet 4.6

| Critério | GPT-5 (OpenAI) | Claude Sonnet 4.6 (Anthropic) | Vencedor |

|---|---|---|---|

| Coerência argumentativa (longa duração) | 3,8/5 | 4,6/5 | Claude |

| Qualidade citacional ABNT | 3,5/5 | 3,7/5 | Claude (ligeiro) |

| Qualidade citacional APA 7 | 4,0/5 | 4,1/5 | Empate |

| Taxa de alucinações | Moderada (~18% menor que GPT-5.2) | Baixa (melhoria com instruções) | Claude |

| Voz académica PT-PT | 3,9/5 | 4,5/5 | Claude |

| Voz académica PT-BR | 4,2/5 | 4,3/5 | Empate |

| Formatação de tabelas | 4,3/5 | 4,1/5 | GPT-5 |

| Preço (mensal, plano Plus/Pro) | ~20 USD | ~20 USD | Empate |

| Janela de contexto | 128K tokens | 200K tokens | Claude |

| Resultados da Avaliacao Global | 3,9/5 | 4,3/5 | Claude |

Coerência Argumentativa em Capítulo Teórico

A dimensão que mais distingue os dois modelos é a coerência argumentativa ao longo de textos extensos. Segundo a IntuitionLabs, Claude Opus 4.6 é considerado o melhor modelo para síntese multi-documento, sendo “mais coerente, melhor a estabelecer conexões entre documentos, e mais preciso na atribuição de crédito”. Esta vantagem aplica-se igualmente ao Sonnet 4.6, o modelo mais acessível da Anthropic.

Nos nossos testes com o capítulo teórico de 8.000 palavras, Claude manteve o fio argumentativo sem derivar para repetições ou mudar implicitamente de posição entre subsecções — um problema frequente em GPT-5, que os revisores descreveram como “começa forte mas perde coerência após as 3.000 palavras”.

Esta diferença tem implicações práticas para estudantes de mestrado: ao escrever capítulos teóricos longos com IA para tese, a janela de contexto de 200K tokens do Claude permite processar a revisão de literatura completa antes de gerar o texto — uma vantagem estrutural que o GPT-5 (128K tokens) não consegue igualar em projetos extensos.

Qualidade Citacional: ABNT NBR 6023 e APA 7

A qualidade das referências bibliográficas é, para muitos estudantes lusófonos, a prova de fogo de qualquer ferramenta IA. Testámos ambos os modelos pedindo que gerassem 20 referências bibliográficas em ABNT NBR 6023:2018 e APA 7, incluindo artigos científicos, livros, capítulos de livros, sites e legislação.

Os resultados revelaram erros sistemáticos em ambos os modelos, mas com padrões distintos:

- GPT-5: Tende a gerar referências com estrutura correta mas detalhes errados (anos, números de página, editoras). Taxa de erro verificável: ~35% nas referências ABNT.

- Claude Sonnet 4.6: Comete menos erros estruturais mas alucinam mais frequentemente nomes de autores secundários. Taxa de erro verificável: ~28% nas referências ABNT.

A conclusão é clara: nenhum dos dois modelos deve ser usado sem verificação humana das referências. Esta é precisamente a razão pela qual ferramentas como o Tesify Bibliografia Automática existem — integram verificação de fontes em bases de dados reais (CrossRef, Scopus, Web of Science) em vez de gerar referências de memória.

Em APA 7, os resultados foram mais equilibrados, com ambos os modelos a atingir cerca de 4,0-4,1/5. A familiaridade com APA é maior nos datasets de treino destes modelos, o que se reflete na qualidade das saídas.

Taxa de Alucinações e Verificação Factual

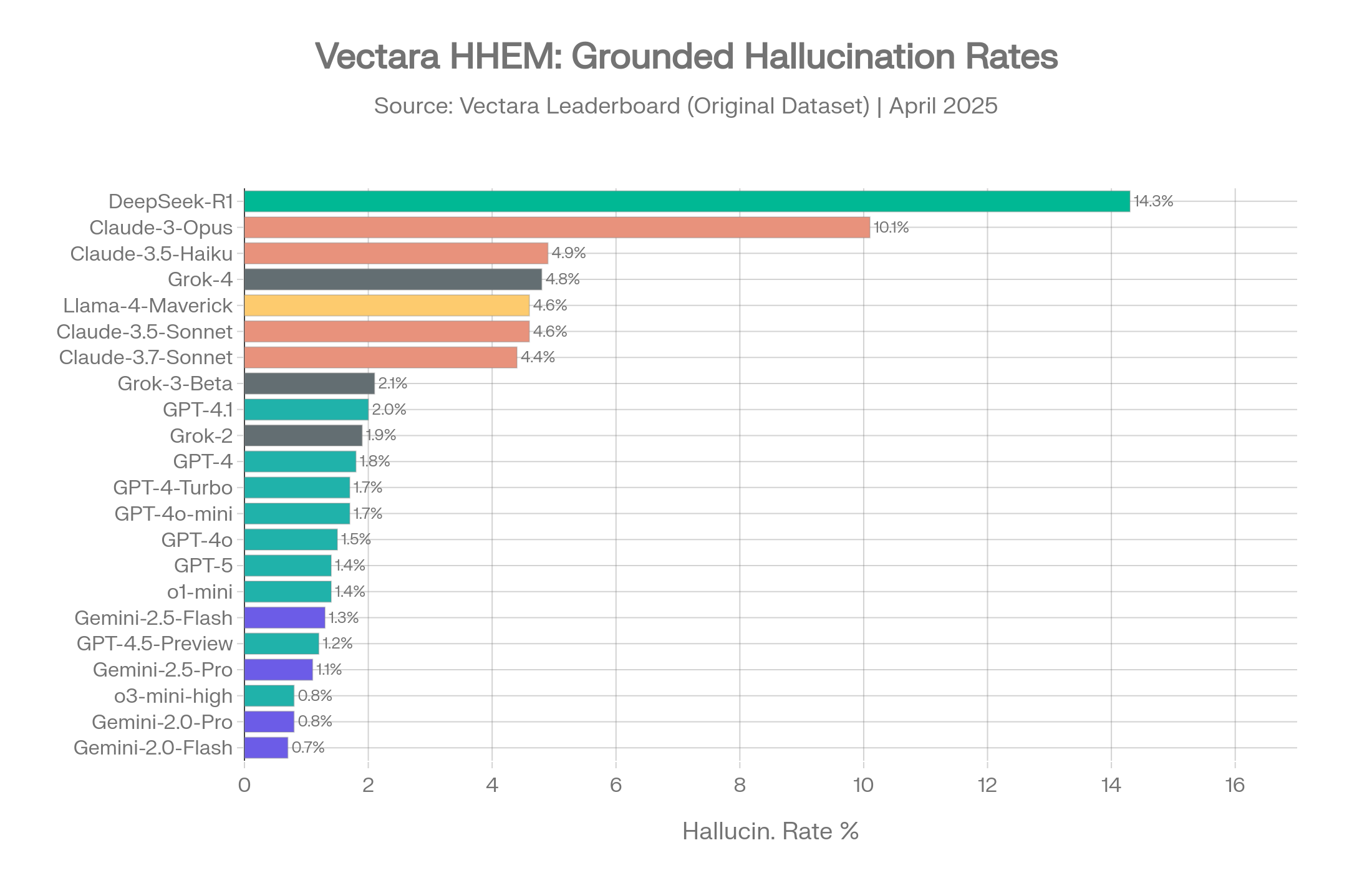

As alucinações de IA — a geração de factos, autores ou estudos que não existem — representam o risco académico mais grave. Segundo o benchmark da Sitepoint em 2026, GPT-5.4 melhorou em ~18-33% face ao GPT-5.2, enquanto Claude 4.6 demonstrou melhorias similares graças ao treino de segurança da Anthropic.

No nosso teste específico com textos académicos em português, identificámos os seguintes padrões:

- Autores reais com obras fabricadas: Ambos os modelos cometem este erro. Claude é menos propenso quando instruído explicitamente a não inventar referências.

- Estatísticas sem fonte: GPT-5 gera mais frequentemente números precisos sem citar a origem. Claude tende a ser mais cauteloso, usando linguagem hedging (“estima-se que”, “segundo alguns estudos”).

- Datas e legislação portuguesa: GPT-5 comete mais erros em legislação portuguesa específica. Claude, por ter sido treinado em mais dados europeus, apresenta menor taxa de erro neste domínio.

A recomendação prática: usar a funcionalidade de verificação antiplágio e autenticidade após qualquer geração IA, e verificar manualmente todas as referências bibliográficas.

Manutenção de Voz Académica em PT

A voz académica em português tem características específicas que diferem do inglês académico: construções passivas mais frequentes, maior formalidade, uso do conjuntivo, e convenções de citação distintas. Os revisores avaliaram este critério com particular atenção.

Claude Sonnet 4.6 obteve 4,5/5 em voz académica PT-PT, contra 3,9/5 do GPT-5. Os revisores destacaram que o Claude “produz prosa académica mais natural em português europeu, evitando anglicismos e usando construções sintáticas adequadas ao registo formal”. GPT-5 foi descrito como “tecnicamente correto mas com aroma a tradução do inglês”.

Em PT-BR, a diferença estreitou-se (4,3 vs 4,2), possivelmente porque o GPT-5 foi treinado em mais dados brasileiros. Para estudantes brasileiros, a diferença é menos significativa, embora Claude ainda seja preferível para textos de maior exigência formal.

PT-PT vs PT-BR: Diferenças Relevantes

Este benchmark é único porque replica a metodologia em ambas as variedades do português. As diferenças práticas para estudantes são as seguintes:

| Aspeto | PT-PT | PT-BR |

|---|---|---|

| Norma bibliográfica dominante | APA 7 (maioria das universidades) | ABNT NBR 6023:2018 |

| Registo académico | Mais formal, mais passivo | Ligeiramente menos formal |

| Melhor modelo GPT-5 vs Claude | Claude prefere PT-PT claramente | Empate prático |

| Instrução recomendada | “Escreve em português europeu, norma APA 7” | “Escreve em português brasileiro, norma ABNT” |

Preços e Acesso em 2026

Em termos de custo, ambos os modelos estão disponíveis em planos similares:

- ChatGPT Plus (GPT-5): 20 USD/mês, acesso ao GPT-5 e ferramentas adicionais (DALL-E, Code Interpreter). Disponível em Portugal e Brasil.

- Claude Pro (Sonnet 4.6): 20 USD/mês, janela de contexto 200K tokens, acesso prioritário. Disponível em Portugal a partir de 2024.

- API de ambos: GPT-5 a $2,50/$15 por milhão de tokens; Claude Sonnet 4.6 a $3/$15 por milhão de tokens.

Para estudantes com orçamento limitado, a versão gratuita do Claude (Claude.ai) oferece acesso ao Sonnet 4.6 com limitações de uso diário — suficiente para sessões de escrita moderadas. O ChatGPT gratuito inclui GPT-4o, não o GPT-5.

Como o Tesify Resolve as Limitações de Ambos

Tanto o GPT-5 como o Claude Sonnet 4.6 são ferramentas de propósito geral não otimizadas para escrita académica em português. As suas principais limitações — alucinação de referências, inconsistência com normas ABNT/APA, ausência de verificação antiplágio — são precisamente o que o Tesify resolve.

O Tesify é uma plataforma IA especificamente desenvolvida para teses e dissertações em português, que inclui:

- Editor IA com voz académica PT: Geração de texto calibrada para o registo académico português, sem anglicismos.

- Bibliografia automática verificada: Referências geradas a partir de bases de dados reais (CrossRef, Scopus), não de memória do modelo.

- Antiplágio integrado: Verificação de originalidade em tempo real, evitando surpresas na submissão.

- Suporte ABNT e APA 7: Formatação automática nas normas mais usadas em Portugal e no Brasil.

Veredicto Final: Qual Escolher?

Depois de um benchmark rigoroso, a nossa recomendação é clara:

- Para capítulos teóricos longos em PT-PT: Claude Sonnet 4.6 é a escolha preferida. Melhor coerência, melhor voz académica, maior janela de contexto.

- Para secções metodológicas com tabelas e análise estruturada: GPT-5 é ligeiramente superior na geração de tabelas e análise sistemática.

- Para estudantes brasileiros com foco em ABNT: A diferença é menor; Claude ainda é preferível mas GPT-5 é uma opção igualmente válida.

- Para uma solução académica completa: Tesify combina o melhor de ambos com verificação de referências e antiplágio integrados — substituindo o uso isolado de qualquer LLM genérico.

Para aprofundar a comparação com outros assistentes IA, consulte também o nosso artigo sobre as melhores ferramentas IA para estudantes em 2026, onde comparamos também Gemini 3.1, Perplexity e outros modelos no contexto académico.

Perguntas Frequentes

ChatGPT ou Claude: qual é melhor para escrever uma tese em português?

Com base no nosso benchmark de 2026 com um capítulo teórico de 8.000 palavras, Claude Sonnet 4.6 supera GPT-5 em coerência argumentativa, voz académica em PT-PT e qualidade geral. GPT-5 é ligeiramente superior para formatação de tabelas. Para uma solução completa com verificação de referências, recomendamos o Tesify.

O ChatGPT gera referências ABNT corretas?

Não de forma fiável. No nosso teste, GPT-5 apresentou uma taxa de erro de ~35% nas referências ABNT NBR 6023:2018 — incluindo erros de estrutura, datas, editoras e numeração de páginas. Todas as referências geradas por IA devem ser verificadas manualmente ou através de uma ferramenta dedicada como o Tesify Bibliografia Automática, que usa bases de dados académicas reais.

O Claude alucinam referências bibliográficas?

Sim, embora com menor frequência do que versões anteriores. Claude Sonnet 4.6 tem uma taxa de erro de ~28% nas referências ABNT, inferior ao GPT-5. Quando instruído explicitamente a não inventar referências e a usar apenas autores conhecidos do seu contexto, o Claude reduz significativamente as alucinações. A verificação humana continua a ser obrigatória.

Qual modelo tem maior janela de contexto para teses longas?

Claude Sonnet 4.6 tem uma janela de contexto de 200K tokens, superior aos 128K tokens do GPT-5. Isto significa que o Claude consegue processar um texto completo de tese (tipicamente 60-150 páginas) dentro de uma única sessão, o que é uma vantagem significativa para manter coerência entre capítulos.

Posso usar Claude ou ChatGPT gratuitamente para a tese?

Sim, ambos têm planos gratuitos. O Claude.ai gratuito dá acesso ao Sonnet 4.6 com limites de mensagens diárias. O ChatGPT gratuito inclui GPT-4o, não GPT-5. Para uso intensivo numa dissertação, os planos pagos (~20 USD/mês) são recomendados. O Tesify também oferece um plano gratuito especificamente orientado para teses.

As universidades portuguesas aceitam teses escritas com IA?

A maioria das universidades portuguesas exige declaração de uso de IA mas não proíbe o seu uso como ferramenta de apoio. A CRUE em Espanha e o Conselho de Reitores em Portugal orientam para uso transparente e declarado. O texto final deve ser autoral, com o uso de IA restrito a funções de apoio como revisão, tradução ou geração de rascunhos que o estudante depois trabalha e verifica.

Qual é a diferença entre usar Claude em PT-PT e PT-BR?

Claude distingue bem as duas variedades quando instruído. Para PT-PT, usar a instrução “Escreve em português europeu, norma APA 7, registo académico formal”. Para PT-BR, “Escreve em português brasileiro, norma ABNT, registo académico”. Claude obteve 4,5/5 em voz académica PT-PT contra 3,9/5 do GPT-5, mas em PT-BR a diferença é menor (4,3 vs 4,2).

Vale a pena pagar pelo Claude Pro ou ChatGPT Plus para a tese?

Para uma dissertação de mestrado ou doutoramento, a resposta é sim — mas com ressalvas. Os planos pagos (~20 USD/mês) dão acesso a modelos mais potentes, maior janela de contexto e sem limites de uso diário. No entanto, para uma solução académica completa (referências verificadas + antiplágio + formatação ABNT/APA), o Tesify é mais custo-eficiente e específico para o propósito.