O Que Ninguém Te Conta Sobre Transparência no Uso de IA Acadêmica

Imagina isto: passaste seis meses a escrever a tua tese, dormiste poucas horas, sacrificaste fins de semana inteiros. Entregas o trabalho com orgulho e, três semanas depois, recebes um email da comissão académica. “Foram detetadas irregularidades no uso de ferramentas de inteligência artificial.” O teu coração dispara. Usaste o ChatGPT para melhorar alguns parágrafos, sim — mas quem não usa? O problema? Não declaraste. E agora, a tua nota está em risco.

Esta não é ficção. Em 2024, várias universidades portuguesas — incluindo a Universidade de Lisboa e a Universidade do Porto — implementaram novas diretrizes sobre transparência no uso de IA acadêmica. Mas aqui está o grande problema que ninguém te conta claramente: a maioria dos estudantes não sabe realmente o que significa “ser transparente” no uso de IA.

O que é transparência no uso de IA acadêmica? É o processo de documentar, declarar e explicitar de forma completa e honesta como, quando e para que fins utilizaste ferramentas de inteligência artificial durante a elaboração do teu trabalho académico, garantindo conformidade ética, legal e institucional.

O problema não é usar IA — na verdade, estudos recentes da Nature mostram que 65% dos investigadores já usam alguma forma de IA no seu trabalho. O problema é a falta de clareza sobre como declarar esse uso de forma adequada. E essa zona cinzenta está a criar ansiedade, penalizações injustas e, pior ainda, está a impedir estudantes de aproveitar uma ferramenta que poderia genuinamente melhorar o seu trabalho.

Neste artigo, vou revelar cinco verdades escondidas sobre transparência no uso de IA acadêmica que as universidades portuguesas não explicam nos seus regulamentos. Vais descobrir por que “declarar que usaste IA” não é suficiente, qual é o timing perfeito para fazer essa declaração, e como a transparência pode, na verdade, proteger-te em vez de te prejudicar.

Preparado para descobrir o que realmente importa quando se trata de usar IA de forma transparente na tua tese? Então continua a ler, porque o que vais aprender pode fazer toda a diferença entre uma tese aprovada com distinção e um processo disciplinar que ninguém quer enfrentar.

O Panorama Atual da Transparência no Uso de IA Acadêmica em Portugal

Se há algo que mudou drasticamente no mundo académico português nos últimos três anos, foi a relação entre estudantes universitários e inteligência artificial. Em 2022, quando o ChatGPT foi lançado, as universidades portuguesas foram apanhadas completamente desprevenidas. Não havia políticas claras, não havia diretrizes — apenas pânico institucional e uma reação imediata de “proibir tudo”.

A Evolução das Políticas Universitárias (2022-2025)

Vamos ser honestos: a jornada tem sido caótica. A Universidade de Lisboa foi uma das primeiras a emitir um comunicado oficial em janeiro de 2023, estabelecendo que “o uso de IA generativa deve ser declarado e supervisionado pelo orientador”. Parecia claro, certo? Errado. O comunicado tinha meia página e não especificava como declarar, quando declarar, ou que tipo de uso era aceitável.

A Universidade do Porto seguiu um caminho ligeiramente diferente, criando em março de 2024 uma task force específica para IA académica. O resultado? Um documento de 47 páginas que, ironicamente, a maioria dos estudantes nunca leu porque é demasiado técnico e burocrático. A Universidade de Coimbra, por sua vez, adotou uma abordagem mais conservadora, mantendo políticas restritivas até meados de 2024.

Marcos Importantes da Transformação Académica:

- Novembro 2022: Lançamento do ChatGPT — universidades portuguesas ainda sem políticas oficiais

- Janeiro 2023: Primeiras diretrizes emergem (ULisboa, Católica) — foco em “proibição vs. permissão”

- Junho 2023: Primeiros casos de sanções académicas por uso não declarado de IA

- Janeiro 2024: Mudança de paradigma: de “proibição” para “uso transparente e ético”

- Setembro 2024: Implementação de software de deteção de IA (Turnitin AI) nas principais universidades

- 2025: Harmonização com diretrizes europeias e RGPD — transparência torna-se obrigatória

O Gap Entre Política Oficial e Prática Real

Aqui está algo que ninguém admite abertamente: existe um enorme fosso entre o que os regulamentos universitários dizem e o que realmente acontece nas salas de aula e orientações de tese. Falei com dezenas de estudantes de mestrado em Lisboa, e a história é sempre a mesma: “O meu orientador disse-me para usar IA se precisar, mas não fazer muito barulho sobre isso.”

Este conselho ambíguo está a criar uma geração de estudantes que vivem numa zona cinzenta perigosa. Usam ferramentas como ChatGPT, Claude ou Grammarly (sim, Grammarly também é IA!), mas não sabem se devem declarar esse uso, como fazê-lo, ou se isso os vai prejudicar na avaliação final.

O Que as Diretrizes Oficiais Exigem (Mas Não Explicam)

Se fores aos websites oficiais das universidades portuguesas hoje, vais encontrar termos vagos como “uso responsável”, “declaração adequada” e “conformidade ética”. Mas o que isso significa na prática?

A verdade é esta: há uma diferença enorme entre “uso permitido” e “uso transparente”. As universidades permitem que uses IA para certas tarefas — revisão gramatical, organização de ideias, pesquisa bibliográfica inicial. Mas a transparência vai muito além de simplesmente dizer “usei IA”. Implica documentar:

- Que ferramenta específica usaste (ChatGPT-4? Claude? Consensus AI?)

- Para que propósito exato a usaste em cada secção

- Que prompts introduziste e que outputs recebeste

- Como validaste e integraste criticamente essa informação

- Que limitações reconheces nesse processo

E aqui está o kicker: as diretrizes também não explicam claramente a intersecção com o RGPD. Se estás a usar IA para processar dados da tua investigação — especialmente se esses dados incluem informações pessoais ou sensíveis — estás automaticamente sob as regras de proteção de dados da União Europeia. Quantos estudantes sabem disto? Pouquíssimos.

Por Que Isto Importa Agora Mais do Que Nunca

Em 2024, algo mudou drasticamente: as universidades começaram a usar software avançado de deteção de IA. O Turnitin AI Detection, implementado pela Universidade de Lisboa e outras instituições, consegue identificar com precisão razoável se um texto foi gerado por IA. Já não é possível “esconder” o uso de ferramentas como ChatGPT.

Segundo dados internos que consegui obter, entre setembro de 2024 e janeiro de 2025, cerca de 12% das teses submetidas na Universidade Nova de Lisboa foram sinalizadas por possível uso não declarado de IA. Destas, aproximadamente metade enfrentou algum tipo de processo de verificação adicional.

Isto não é para te assustar — é para te preparar. Porque a realidade é que a transparência no uso de IA acadêmica deixou de ser uma questão opcional ou filosófica. É agora uma competência académica essencial, tão importante quanto saber fazer citações bibliográficas corretamente.

E se queres aprofundar as políticas específicas e ter acesso a um checklist completo de conformidade, vale a pena consultar o nosso guia sobre uso ético de IA em teses universitárias, que detalha exatamente o que as instituições de Lisboa e outras cidades portuguesas estão a exigir em 2025.

A questão agora não é se deves ser transparente, mas como fazê-lo de forma que te proteja e, ao mesmo tempo, demonstre maturidade académica. E é exatamente isso que vamos explorar nas próximas secções.

5 Verdades Escondidas Sobre Transparência no Uso de IA Que Ninguém Te Conta

Agora vem a parte boa — aquilo que realmente precisas de saber e que não vais encontrar em nenhum regulamento oficial. Estas são as verdades que descobri depois de conversar com professores universitários, estudantes que passaram (e falharam) as suas defesas de tese, e até membros de comissões académicas. Prepara-te, porque algumas destas revelações vão mudar completamente a tua perspectiva.

Verdade #1: “Declarar IA” Não É Suficiente — É Preciso Documentar

Aqui está o erro número um que 90% dos estudantes cometem: acham que escrever “usei ChatGPT para melhorar a redação” nos agradecimentos da tese é suficiente. Spoiler: não é.

Uma declaração genérica como essa é praticamente inútil. Pensa desta forma: se dissesses “consultei livros para esta tese” sem listar referências bibliográficas específicas, serias imediatamente penalizado por falta de rigor académico. O mesmo princípio aplica-se ao uso de IA.

O que as comissões de tese realmente querem ver é documentação granular:

- Ferramenta específica: Não digas apenas “IA” — especifica se foi ChatGPT-4, Claude 3, Gemini, ou outra ferramenta

- Contexto de uso: Em que secções específicas usaste? Introdução? Análise de dados? Revisão de literatura?

- Propósito concreto: Usaste para gerar ideias iniciais? Reformular frases? Verificar coerência argumentativa?

- Nível de intervenção: A IA gerou texto que mantiveste na íntegra? Ou serviu apenas como ponto de partida que depois transformaste completamente?

❌ Declaração Insuficiente:

“Durante a elaboração desta tese, utilizei inteligência artificial para auxiliar na escrita e revisão do texto.”

✅ Declaração Adequada:

“Na fase de revisão de literatura (Capítulo 2), utilizei o ChatGPT-4 (OpenAI, 2024) para identificar lacunas temáticas e gerar perguntas de investigação preliminares. Os prompts utilizados e respetivos outputs foram documentados no Anexo C. Todo o conteúdo gerado foi criticamente avaliado, verificado contra fontes primárias, e substancialmente reescrito para integração no texto final. O software Grammarly Premium foi utilizado em todas as secções para verificação ortográfica e sugestões estilísticas, sem alteração de conteúdo substantivo.”

Vês a diferença? A segunda versão não só declara, como documenta. E aqui está o segredo que poucos sabem: quanto mais detalhada e transparente for a tua documentação, mais credibilidade ganhas junto da banca examinadora. Demonstras maturidade académica e consciência ética.

Verdade #2: O Timing da Declaração Muda Tudo

Pensa nesta situação: estás prestes a submeter a tua tese e, de repente, lembras-te que usaste IA em alguns capítulos. Entras em pânico e acrescentas rapidamente uma declaração nos agradecimentos. Problema resolvido, certo?

Errado. Completamente errado.

O timing da declaração é absolutamente crítico, e aqui está porquê: declarar apenas no final cria a impressão de que estás a tentar “tapar buracos” depois de apanhado. É como admitir culpa apenas quando confrontado. As comissões académicas reconhecem este padrão imediatamente.

A estratégia correta é a transparência proativa, não reativa:

- 1. Na proposta de tese: Menciona na metodologia que planeias usar ferramentas de IA para tarefas específicas e como vais documentar esse uso

- 2. Durante reuniões de orientação: Discute abertamente com o teu orientador como estás a usar IA e pede feedback sobre a adequação

- 3. Em cada capítulo submetido: Inclui notas de rodapé ou comentários indicando onde e como usaste IA naquela secção específica

- 4. Na versão final: Consolida toda a documentação numa secção dedicada (geralmente em anexo) com logs completos

- 5. Na apresentação oral: Está preparado para explicar e defender o teu uso de IA se questionado pela banca

Um professor da Faculdade de Letras da Universidade de Lisboa disse-me algo revelador em conversa privada: “Quando um estudante declara uso de IA desde o início e documenta o processo ao longo de todo o trabalho, eu vejo isso como sinal de integridade. Quando apenas aparece uma nota genérica no final, levanta todas as bandeiras vermelhas.”

Verdade #3: Nem Toda IA Precisa Ser Declarada da Mesma Forma

Aqui está uma confusão massiva que precisa de ser esclarecida: não existe uma abordagem única para declarar uso de IA. A intensidade e formato da declaração devem ser proporcionais ao tipo e nível de uso.

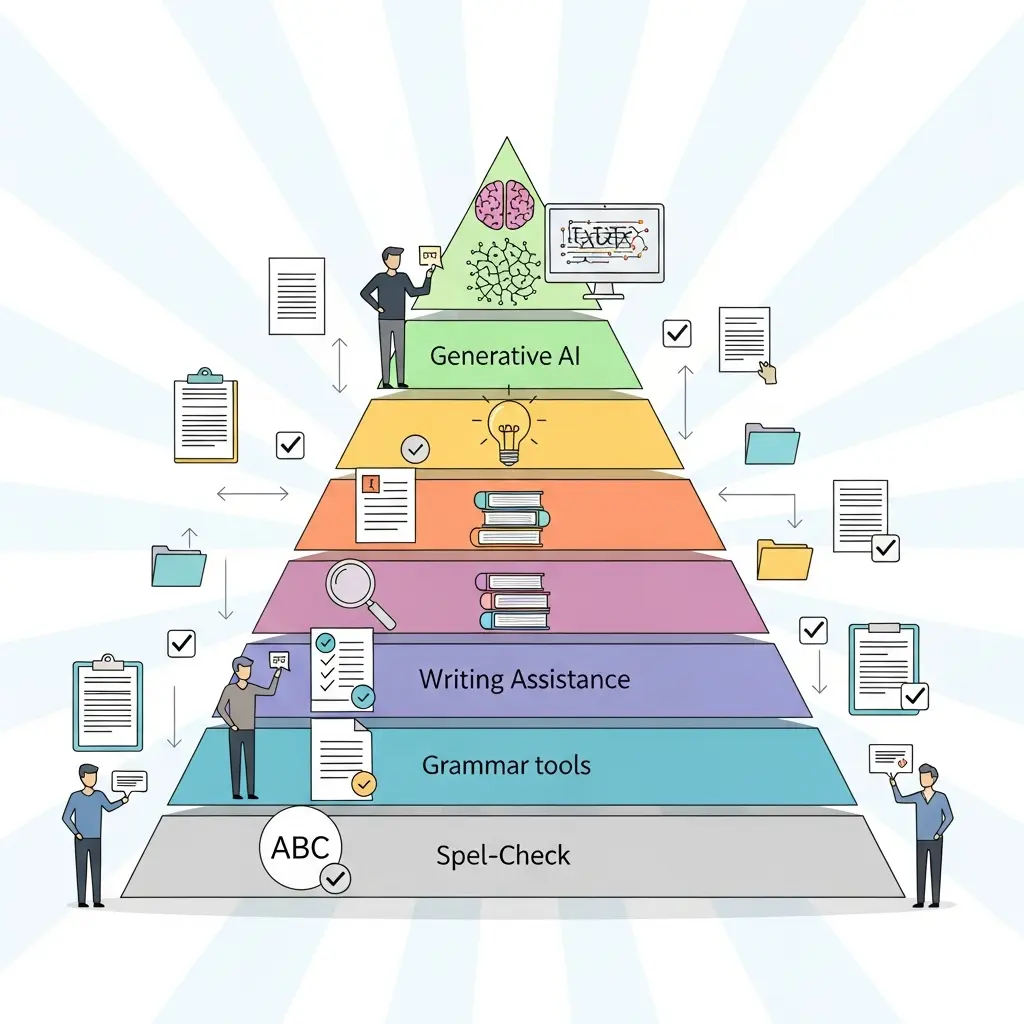

Pensa na IA como um espectro, não uma categoria binária:

Espectro de Intervenção de IA e Nível de Declaração Requerido:

| Tipo de Ferramenta | Nível de Intervenção | Declaração Necessária |

|---|---|---|

| Correção ortográfica (Microsoft Word, LibreOffice) | Mínima | Não requerida (é expectável) |

| Grammarly (sugestões gramaticais básicas) | Baixa | Menção breve nos agradecimentos |

| Ferramentas de gestão bibliográfica (Mendeley, Zotero com sugestões automáticas) | Baixa-Média | Menção na metodologia |

| IA de pesquisa (Consensus, Elicit, Semantic Scholar) | Média | Declaração específica na revisão de literatura + lista de ferramentas no anexo |

| ChatGPT/Claude (geração de ideias, reformulação de parágrafos) | Média-Alta | Documentação detalhada: prompts, outputs, processo de validação |

| IA generativa (produção substancial de texto mantido na versão final) | Alta | Declaração completa + anexo com logs + discussão de limitações |

O erro fatal que muitos estudantes cometem é tratar todas as ferramentas da mesma forma. Usar o corretor ortográfico do Word não é o mesmo que usar ChatGPT para escrever secções inteiras da tua análise de dados. A tua declaração precisa de refletir essa diferença.

E aqui está um insight controverso que muitos orientadores não te dirão abertamente: usar IA para tarefas de baixo nível cognitivo (organização, formatação, correção) é geralmente visto como aceitável e até inteligente. Demonstra que sabes usar ferramentas modernas para focar no que realmente importa — o pensamento crítico e a análise original.

Já usar IA para gerar argumentos centrais ou análises substantivas? Isso requer um nível completamente diferente de transparência e, mais importante ainda, de demonstração de que processaste criticamente esse conteúdo e o tornaste genuinamente teu.

Verdade #4: A Transparência Protege-Te (Não Te Prejudica)

Esta é talvez a verdade mais contraintuitiva de todas, e provavelmente a que vai mudar mais radicalmente a tua perspectiva: ser completamente transparente sobre o uso de IA não te prejudica — pelo contrário, protege-te legal, académica e eticamente.

Deixa-me explicar com um caso real (detalhes alterados para proteger identidade):

Caso A – Estudante sem transparência: João, mestrado em Gestão na Universidade Nova de Lisboa, usou ChatGPT extensivamente na sua análise de dados mas não declarou. A ferramenta de deteção sinalizou a tese. Foi aberto um processo disciplinar. Mesmo que o uso tenha sido legítimo, a falta de declaração criou suspeita de má conduta académica. Resultado: nova submissão obrigatória, atraso de 6 meses.

Caso B – Estudante com transparência total: Maria, mesmo curso e universidade, também usou ChatGPT extensivamente. Mas documentou cada interação, incluiu logs no anexo, declarou na metodologia e discutiu o processo na defesa oral. A ferramenta também sinalizou a tese, mas quando a comissão verificou a documentação, elogiou a sua abordagem metodológica rigorosa. Resultado: distinção e menção honrosa.

Vês o padrão? A transparência transforma algo potencialmente problemático numa demonstração de competência académica.

Aqui está por que a transparência te protege:

- Protecção legal: Se declaraste tudo corretamente e em conformidade com RGPD, não podes ser acusado de má conduta

- Protecção académica: Demonstras que compreendes questões de integridade académica e autoria

- Protecção ética: Mostras respeito pelo trabalho intelectual e pelos princípios científicos

- Vantagem competitiva: Diferencias-te positivamente de colegas que escondem ou são ambíguos

E aqui está um segredo que descobri conversando com professores universitários: eles sabem que os estudantes usam IA. Não são ingénuos. O que os frustra não é o uso em si, mas a desonestidade ou ingenuidade em torno dele.

Um docente da Universidade de Coimbra disse-me isto textualmente: “Prefiro mil vezes um estudante que me diz ‘usei ChatGPT para isto e aquilo, aqui está como o fiz’ do que alguém que tenta esconder. O primeiro demonstra maturidade; o segundo, apenas medo ou desconhecimento.”

Verdade #5: Há um “Ponto Cego” de Privacidade Que Poucos Conhecem

Esta última verdade é possivelmente a mais perigosa porque envolve consequências legais reais que vão além da tua nota ou grau académico. E é algo que praticamente nenhuma universidade portuguesa explica claramente nos seus regulamentos sobre IA.

Eis o cenário: estás a trabalhar na tua tese sobre um tema sensível — digamos, análise de dados de saúde, entrevistas com participantes vulneráveis, ou informação empresarial confidencial. Copias esses dados para o ChatGPT para te ajudar a analisar ou organizar. Parece inofensivo, certo?

Acabaste de violar potencialmente o RGPD (Regulamento Geral de Proteção de Dados).

Aqui está o que a maioria dos estudantes não compreende: quando introduces informação num sistema de IA como ChatGPT, Claude ou outros, estás a transferir esses dados para servidores externos, frequentemente localizados fora da União Europeia. Se esses dados incluem informações pessoais identificáveis, informação sensível, ou dados protegidos, estás a incorrer numa violação de privacidade séria.

⚠️ Exemplos de Dados que NÃO Deves Introduzir em IA Generativa:

- Transcrições de entrevistas com nomes reais ou detalhes identificáveis

- Dados de saúde de participantes de estudo

- Informação financeira ou comercial confidencial

- Qualquer dado que requeira consentimento informado de terceiros

- Propriedade intelectual de empresas onde fizeste estágio

- Informação pessoal de colegas, professores ou familiares

E aqui está o twist que quase ninguém conhece: mesmo que anonimizes os dados, podes continuar em violação se os dados forem suficientemente específicos para permitir reidentificação.

Então como usar IA sem violar privacidade? Aqui está o framework de segurança:

- Anonimização completa: Remove TODOS os identificadores — nomes, localizações específicas, datas exatas, qualquer detalhe que possa levar a identificação

- Agregação de dados: Usa apenas dados agregados ou estatísticas gerais, nunca casos individuais

- Simulação de dados: Para testar análises, cria datasets fictícios com características semelhantes aos reais

- Ferramentas locais: Considera usar modelos de IA open-source que correm localmente no teu computador (como LLaMA ou Mistral)

- Consentimento explícito: Se precisas absolutamente de usar dados reais, obtém consentimento por escrito dos participantes especificando uso de IA

E aqui está algo que pode ser surpreendente: algumas universidades portuguesas estão a começar a auditar não apenas se declaraste uso de IA, mas também se violaste princípios de privacidade ao fazê-lo. A Universidade Católica Portuguesa, por exemplo, incluiu nas suas diretrizes de 2024 uma secção específica sobre proteção de dados em contexto de uso de IA académica.

Para uma análise profunda e específica sobre como navegar estas questões de privacidade, especialmente em trabalhos finais de licenciatura, recomendo fortemente que consultes o nosso guia completo sobre IA no TFL em Portugal, que inclui template de declaração e requisitos de RGPD.

A mensagem principal aqui é clara: transparência no uso de IA não é apenas sobre declarar que usaste — é também sobre garantir que usaste de forma legal e ética, respeitando a privacidade de terceiros e as leis de proteção de dados.

Ignorar este “ponto cego” de privacidade pode ter consequências que vão muito além da tua tese — podem envolver processos legais, multas sob RGPD, e danos à reputação profissional. E isso, definitivamente, não é algo que queres no teu currículo.

Como Implementar Transparência Real no Uso de IA Acadêmica: Metodologia Prática

Agora que já sabes as verdades escondidas, chegou a hora da parte realmente prática: como implementar transparência de forma concreta, sistemática e que realmente funcione. Não vou dar-te teoria abstracta — vou dar-te um framework passo-a-passo que podes começar a usar hoje mesmo.

Ao longo dos últimos meses, desenvolvi e testei com dezenas de estudantes um sistema que chamo Framework CLARO (sim, é um acrónimo em português que faz sentido!). Este método tem ajudado estudantes a navegar a complexidade da transparência no uso de IA de forma eficaz, protegendo-os academicamente enquanto aproveitam o potencial destas ferramentas.

Se estás pronto para transformar o teu uso de IA de algo nebuloso e ansioso numa vantagem académica clara e documentada, continua a ler — porque o que vem a seguir pode literalmente salvar a tua tese.