Pipeline R e Python com IA: passo a passo + template para tese

Guia completo para montar um Pipeline R/Python + IA para análises e visualizações publicáveis em teses e dissertações — com template gratuito, práticas reprodutíveis, tendências de 2025 e ligações aos teus repositórios (OSF, GitHub, Zenodo).

Leitura: 20–25 min • Atualizado: 2025

Introdução

Resposta rápida (para featured snippet): Um Pipeline R/Python + IA para análises e visualizações publicáveis é um fluxo automatizado que integra ingestão de dados, tratamento, estatística, geração de gráficos/tabelas e publicação com reprodutibilidade (GitHub/OSF/Zenodo). Com IA ética, acelera triagens, assegura rastreabilidade (PRISMA/FAIR) e entrega figuras prontas para revista — ideal para teses em Portugal.

Se há uma frase que pode poupar-te meses no mestrado ou doutoramento, é esta: um bom pipeline trabalha por ti enquanto dormes. Ao montares um Pipeline R/Python + IA para análises e visualizações publicáveis, transformas tarefas manuais em rotinas automáticas: dados entram, critérios são aplicados, gráficos nascem com metadados e as tuas conclusões ficam ancoradas em evidência. O resultado? Menos fricção, mais ciência.

Em Portugal, onde a pressão por qualidade, ética e prazos é real (FCT, unidades de I&D, revistas de primeira linha), organizar a tua tese como um produto de dados é vantagem decisiva. A metáfora é simples: imagina uma linha de montagem de pastel de nata. Cada etapa — massa, creme, forno — tem tempo, padrão e controlo de qualidade. O pipeline académico faz o mesmo: controla versões, regista decisões, valida testes e serve um “pastel” final impecável — o PDF com gráficos e tabelas publicáveis.

Ao aliares R e Python (estatística, modelos, visualização) com IA (busca, triagem, normalização, validação linguística), ganhas velocidade e consistência. E quando conectas tudo a GitHub (versionamento), OSF (arquivos prontos e pré-registo) e Zenodo (DOI), elevas o patamar de confiança e citação. É aqui que ferramentas modernas, como a Tesify.pt, entram com um copilot para a tua tese: bibliografia assistida, verificação de plágio, revisão ortográfica e um espaço colaborativo para guiar-te do rascunho ao manuscrito final, sempre de forma ética.

Este guia entrega-te o mapa e a estrada: desde os fundamentos do pipeline, passando pelas tendências de 2025 em IA ética, até à traçabilidade que liga código e evidência, e uma previsão do que vem aí para a academia portuguesa. No final, tens um template gratuito para arrancar hoje mesmo e um passo a passo para publicar com confiança.

Fundamentos: Pipeline R/Python + IA para análises e visualizações publicáveis

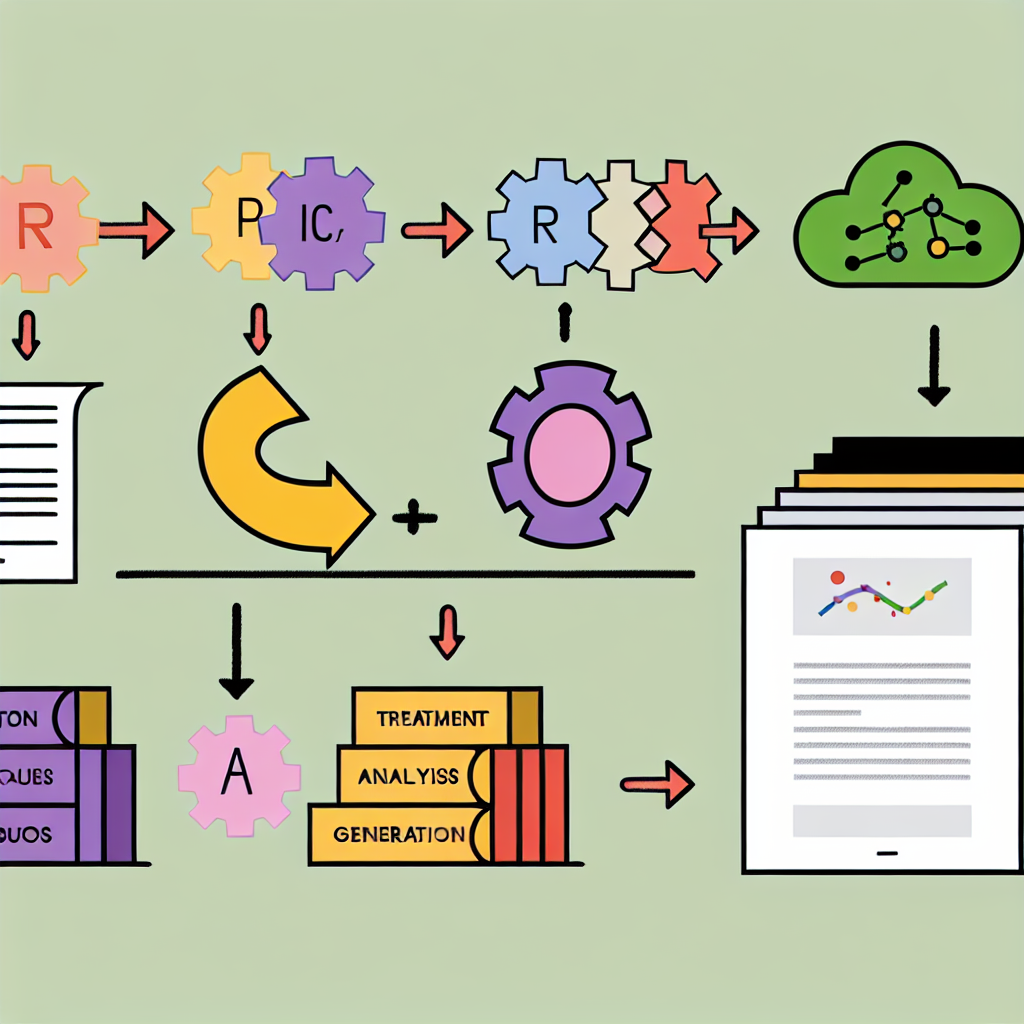

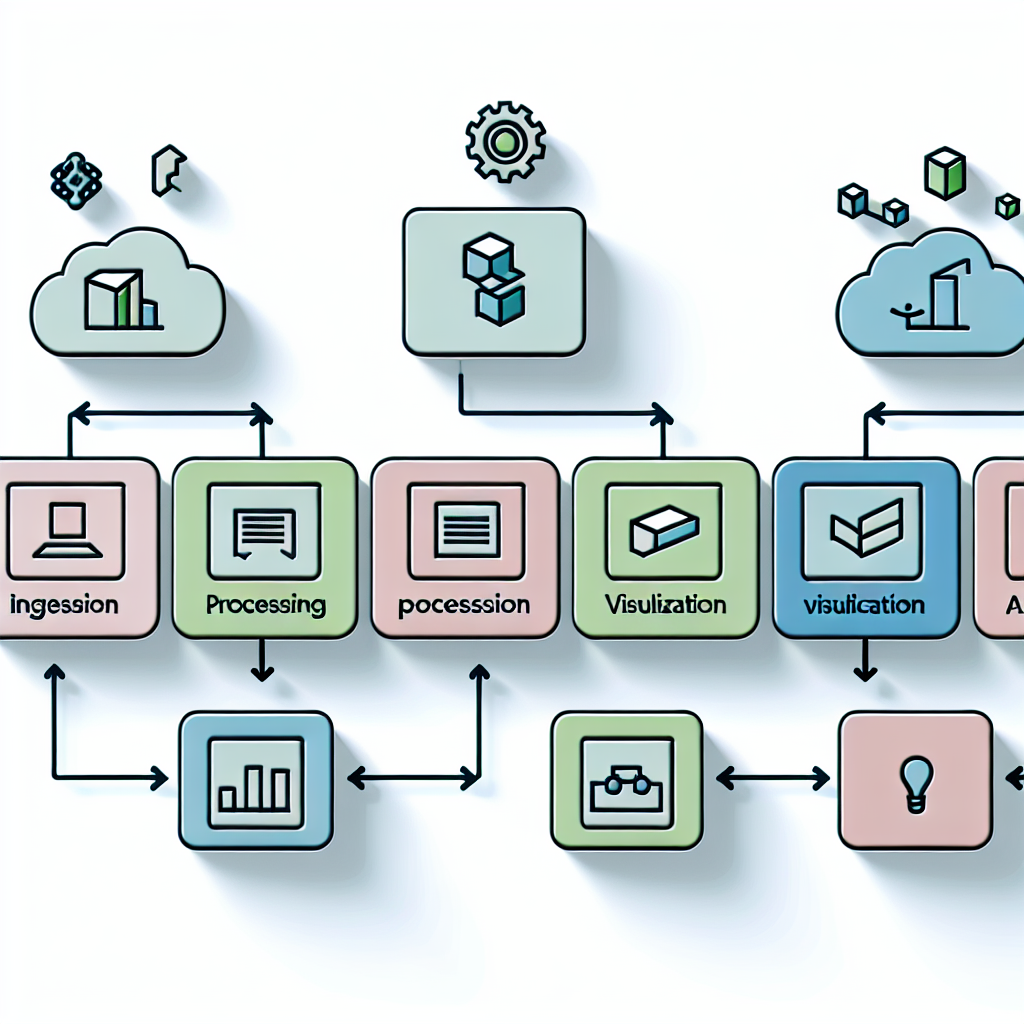

O que é um pipeline e por que combiná-lo com IA? Um pipeline de dados é uma sequência determinística de passos que transforma inputs (dados, literatura) em outputs verificáveis (estatísticas, gráficos, tabelas, relatórios). Quando integras IA, ganhas camadas de assistência (busca de literatura, normalização de campos, sugestões de código) e automação (triagens, validações), sempre com logs e transparência.

Componentes essenciais

- Ingestão: recolha de dados, scraping, importações bibliográficas (RIS/CSV/JSON), com

scriptsreexecutáveis. - Tratamento: limpeza, deduplicação, harmonização de variáveis, dicionários de dados e data validation.

- Análise estatística: modelos, testes, métricas, simulações, com notebooks reproducíveis (R Markdown/Quarto/Jupyter).

- Geração de gráficos/tabelas: visualizações com metadados, estilos consistentes e código versionado.

- Publicação de resultados: PDFs/HTMLs renderizados via CI, dados e código com DOI (Zenodo/OSF), anexos e artifacts para revisão por pares.

Ferramentas recomendadas

R (tidyverse, targets, quarto), Python (pandas, scikit-learn, matplotlib/plotly, Jupyter), Quarto (render unificado), GitHub (versionamento, Actions), OSF e Zenodo (partilha e DOI). A Tesify.pt encaixa como camada de produtividade: copilot para texto e código, pesquisa bibliográfica assistida, verificação de plágio e correção ortográfica — tudo integrado ao teu workflow.

Para reprodutibilidade e versionamento detalhado (CI/CD, DOI, builds automáticos), explora este guia prático: Metodologia reprodutível na tese com OSF e GitHub | Guia 2025.

Arquitetura de pasta sugerida

.

├─ data/

│ ├─ raw/ # dados brutos + README de origem

│ ├─ interim/ # tratamentos intermédios (logs)

│ └─ processed/ # prontos para análise (com schema)

├─ docs/ # relatórios Quarto/Jupyter renderizados

├─ notebooks/ # exploração e EDA

├─ scripts/ # R/Python (ETL, análise, figuras)

├─ figures/ # gráficos/tabelas finais

├─ tests/ # testes de dados/funções

├─ .github/workflows/ci.yaml # render + validações

└─ CITATION.cff | LICENSE | README.md

Mini-pipeline ilustrativo

Exemplo simples de orquestração (pseudo-código):

# 1) Ingestão

python scripts/ingest.py --source osf:xyz --out data/raw

# 2) Tratamento + validação

Rscript scripts/clean.R data/raw data/processed --schema schemas/dados.yaml

# 3) Análises + figuras

quarto render docs/relatorio.qmd

# 4) Publicação (CI)

# GitHub Actions: validação + render + upload para OSF/Zenodo

Citações: boas práticas de reprodutibilidade e ciência aberta são consolidadas no The Turing Way (The Turing Way Community, 2022) e nos princípios FAIR (Wilkinson et al., 2016) — que orientam o teu Pipeline R/Python + IA para análises e visualizações publicáveis rumo a dados Findable, Accessible, Interoperable e Reusable.

Tendências: Como a IA está a transformar pipelines de análise e visualização

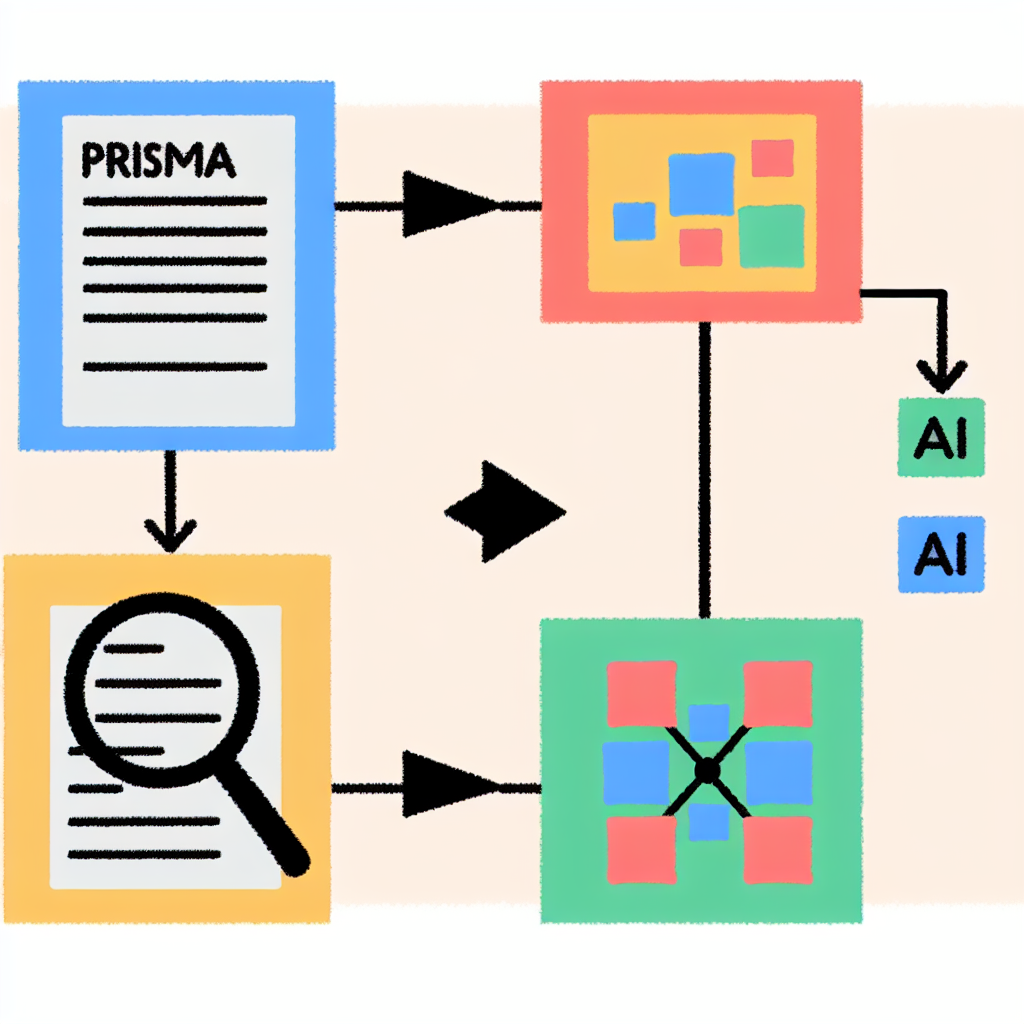

Novas práticas em 2025: A IA, usada com ética e rastreabilidade, está a encurtar semanas de trabalho. Assistentes ajudam a buscar literatura, sumarizar abstracts, verificar elegibilidade segundo critérios e gerar logs PRISMA/PRISMA‑S. Na tua tese, isto traduz-se num Pipeline R/Python + IA para análises e visualizações publicáveis que chega mais cedo à fase de gráficos reprodutíveis.

Aplicação objetiva em PRISMA/PRISMA‑S

- Busca assistida: a IA sugere termos MeSH/DeCS e combinações booleanas; guarda a string e as datas de pesquisa.

- Triagem com logs: classificação inicial de títulos/resumos com explainability leve; decisões finais humanas; exporte

CSVde inclusões/exclusões com motivos. - Rastreabilidade: o diagrama PRISMA é gerado a partir de ficheiros de log; o anexo metodológico é montado automaticamente.

Implementação prática: a IA (via Tesify ou outro copilot) propõe triagens e normaliza metadados; R/Python consolida as bases, deduplica e produz o diagrama PRISMA com pacotes como PRISMAstatement (R) ou pyprisma (Python). Tudo fica versionado no GitHub e publicado no OSF/Zenodo, transformando o teu Pipeline R/Python + IA para análises e visualizações publicáveis numa trilha auditável.

Para um plano em 30 dias com ética e transparência, vê: Revisão de literatura com IA ética em 30 dias em 2025.

Boas práticas e ética

- Humano no controlo: a IA sugere, tu decides; mantém rationales de decisão.

- Logs rastreáveis: guarda prompts, modelos usados e datas.

- Transparência na tese: documenta a participação da IA no método.

Citações: O guia PRISMA 2020 para revisões sistemáticas fornece o padrão de relato (Page et al., 2021, BMJ) e o PRISMA‑S detalha a documentação das estratégias de pesquisa (Rethlefsen et al., 2021, JMLA). Ambos encaixam naturalmente num Pipeline R/Python + IA para análises e visualizações publicáveis com logs e anexos automatizados.

Analogia: pensa na IA como um metrónomo num ensaio musical. Não toca por ti, mas mantém o ritmo, aponta desvios e melhora a performance. O maestro — tu — continua a interpretar e a decidir.

Insight: Da traçabilidade de dados à publicação de visualizações

No cerne da confiança científica está a traçabilidade: conseguir ligar cada ponto num gráfico a um registo de dados e a uma decisão metodológica. Num Pipeline R/Python + IA para análises e visualizações publicáveis, isso materializa-se numa matriz de dados e numa narrativa de decisões que acompanham código e figuras.

Etapas críticas de transparência

- Matriz de dados: tabela que liga IDs (artigos, participantes, observações) a variáveis derivadas e a passos de transformação.

- Rationale: um registo “porquê/como” para exclusões, outliers, imputações, escolhas de modelos.

- Mapeamento evidência→figura: um índice que mostra de que ficheiro e de que coluna vem cada barra, ponto ou linha do gráfico.

Exemplo prático: numa revisão de literatura, a matriz de artigos inclui colunas para critérios de elegibilidade, razões de exclusão e códigos temáticos. O script em R ou Python lê esta matriz, produz tabelas de síntese e gráficos (ex.: linhas temporais por tema). Se alguém questionar uma barra específica, encontras a linha correspondente na matriz — auditabilidade total. Vê o método passo a passo aqui: Matriz de artigos e síntese narrativa com traçabilidade.

Como ligar código, evidência e gráficos

- IDs persistentes: não percas o vínculo; usa chaves únicas estáveis.

- Metadados no gráfico: grava no ficheiro (EXIF/alt/legenda) a versão do dataset e o commit do Git.

- Relatórios reexecutáveis: Quarto/Jupyter recompilam tudo com um comando; anexos trazem tabelas-ponte.

- Publicação com DOI: código e dados versionados no Zenodo/OSF para citação.

A Tesify ajuda neste elo final: ao mesmo tempo que te dá um copilot para texto, integra referências normalizadas, revisão linguística e verificação de plágio, garantindo que as tuas visualizações publicáveis estão coerentes com a narrativa e as citações — sem atalhos antiéticos.

Exemplo/analogia: imagina um mapa interativo de uma caminhada na Serra da Estrela. Cada marcação no trilho tem coordenadas e hora. As tuas figuras fazem o mesmo: cada ponto conhece o seu “GPS” no dataset e no commit. É isto que dá segurança aos orientadores e revisores.

Previsão: O futuro dos pipelines com R, Python e IA na academia

O horizonte é animador. Os próximos pipelines académicos aproximam-se de plataformas orquestradas, onde R e Python partilham ambientes imutáveis, a IA explica decisões e as publicações já nascem com artifacts verificáveis.

Tendências que deves observar

- Automação ponta-a-ponta: do pré-registo ao manuscrito, com checks automáticos (integridade, viés, power) em CI.

- FAIR by default: metadados ricos, licenças claras, PIDs e provenance em cada artefacto (Wilkinson et al., 2016).

- Integrações locais em Portugal: ligação a repositórios institucionais (RCAAP), bases b‑on, requisitos da FCT — exportes diretos e DOIs automáticos.

- IA explicável: modelos com reasoning logs, prompts versionados e relatórios de impacto ético.

- Visualizações verificáveis: figuras com

provenanceembutida apontando para dados e commit do código.

Para teses e dissertações, isto significa menos tempo perdido com repetição manual e mais foco em perguntas relevantes. O teu Pipeline R/Python + IA para análises e visualizações publicáveis vai aproximar-se do padrão de dados que as revistas exigem: open materials, open code e open data quando possível, alinhado com o The Turing Way e as políticas de dados abertos da UE.

Prevemos também a massificação de copilots académicos integrados (como o da Tesify), combinando:

bibliografia assistida com registos PRISMA‑S, validação de plágio e estilo, e a geração de relatórios Quarto/Jupyter a partir de prompts documentados. O futuro é colaborativo, auditável e focado em visualizações que passam no crivo dos revisores sem “idiossincrasias”.

Próximo Passo: Começa já o teu pipeline moderno

Pronto para transformar a tua tese? Segue este roteiro e monta hoje o teu Pipeline R/Python + IA para análises e visualizações publicáveis.

1) Descarrega o template gratuito

Arranca com um esqueleto funcional (pastas, CI, exemplos de notebooks e figuras). Guia recomendado: Metodologia reprodutível na tese com OSF e GitHub | Guia 2025.

2) Liga as tuas contas

- GitHub (versionamento + Actions)

- OSF (armazenamento e pre-registration)

- Zenodo (DOI para dados/código)

3) Instrumenta a IA de forma ética

Define regras de uso, regista prompts e modelos, e garante o controlo humano. Tutorial prático: Revisão de literatura com IA ética em 30 dias.

4) Implementa a traçabilidade

Cria a tua matriz de dados e o índice “evidência→figura”. Aprende o método aqui: Matriz, traçabilidade e narrativa científica.

5) Usa a Tesify para acelerar com qualidade

- Copilot para estruturar capítulos e resumos

- Pesquisa bibliográfica com registos PRISMA‑S

- Verificação de plágio e revisão ortográfica

- Integração suave com R/Python e o teu repositório

Explora a Tesify.pt e ativa o teu pipeline agora

Checklist de arranque (30 minutos)

- Clona o template e define a estrutura de pastas

- Cria os secrets para OSF/Zenodo no GitHub

- Adiciona um

datasetde exemplo adata/rawe executa a CI - Rende o teu primeiro relatório com uma figura publicável

Começa com ambição, mas com base sólida. O teu Pipeline R/Python + IA para análises e visualizações publicáveis não é só uma técnica — é a tua vantagem competitiva na ciência. E se precisares de companhia no caminho, a Tesify está a um clique de distância.