Estás a usar inteligência artificial na tua tese de doutoramento em Medicina? Atenção: um simples erro pode custar-te meses de trabalho — ou pior, a aprovação.

Imagina isto: passaste dois anos a desenvolver a tua investigação, centenas de horas em revisões de literatura, e quando finalmente submetes a tese… ela é rejeitada pela comissão de ética. O motivo? Uso inadequado de ferramentas de IA.

Não estou a exagerar. Em 2024, estimativas de várias universidades europeias apontam que cerca de 34% das teses com problemas éticos tinham questões relacionadas com o uso de inteligência artificial — desde texto não verificado até violações de privacidade de dados clínicos.

Aqui está o dilema que enfrentas: as ferramentas de IA para teses de doutoramento são incrivelmente poderosas. Podem poupar-te dezenas de horas, ajudar-te a organizar literatura, gerar primeiros rascunhos e até estruturar argumentos complexos. Mas em Medicina, os riscos são amplificados.

Porquê? Porque lidas com dados sensíveis de pacientes. Porque as diretrizes ICMJE e COPE são cada vez mais rigorosas. Porque uma “alucinação” do ChatGPT sobre uma dosagem pode transformar-se num erro grave no teu manuscrito.

Os 7 erros mais comuns ao usar ferramentas de IA para teses de doutoramento em Medicina são:

- Usar ChatGPT para gerar texto clínico sem verificação

- Ignorar diretrizes de disclosure universitárias e de revistas

- Confiar em ferramentas de paráfrase para evitar plágio

- Usar IA para revisão sistemática sem validar fontes

- Não adaptar o output da IA à linguagem científica médica

- Introduzir dados de pacientes em ferramentas não seguras

- Dispensar orientação humana

Neste guia, vou desmontar cada um destes erros e dar-te soluções práticas, específicas para quem está a fazer doutoramento em Medicina em Portugal. Se já leste o nosso artigo sobre erros fatais ao usar IA em teses, sabes que esta é uma área onde não há espaço para amadorismo.

Vamos a isto?

O Contexto Atual da IA em Teses de Medicina em Portugal

Nos últimos dois anos, o cenário mudou drasticamente. O que antes era uma curiosidade tecnológica tornou-se numa ferramenta quotidiana para milhares de investigadores.

Em Portugal, universidades como a Universidade do Porto, a Universidade de Lisboa e a Universidade de Coimbra já estão a desenvolver políticas específicas sobre o uso de IA em trabalhos académicos. Mas aqui está o problema: muitos doutorandos não conhecem estas regras — ou assumem que “se funciona, está bem”.

No doutoramento em Medicina, as especificidades são ainda maiores. Estamos a falar de:

- Revisões sistemáticas que devem seguir protocolos PRISMA rigorosos

- Dados clínicos protegidos por RGPD e sigilo médico

- Publicação em revistas indexadas que exigem transparência total

📋 Diretrizes ICMJE 2024: “Os autores devem divulgar o uso de ferramentas de IA generativa e assumir total responsabilidade pelo conteúdo gerado.”

O COPE (Committee on Publication Ethics) é ainda mais direto: a IA não pode ser autora. Ponto final. Tens a obrigação de declarar qualquer uso de ferramentas generativas, e a responsabilidade pelo conteúdo é inteiramente tua.

Se queres um panorama completo das ferramentas disponíveis, recomendo que explores o nosso guia sobre ferramentas de IA para escrita de teses académicas em 2025.

Os 7 Erros Fatais — E Como Evitá-los

Agora sim, vamos ao que interessa. Cada erro que vou apresentar é algo que vejo acontecer repetidamente — e que pode ser evitado com as estratégias certas.

Erro #1 — Gerar Texto Clínico Sem Verificação

Este é, de longe, o erro mais comum e o mais perigoso.

O ChatGPT é brilhante para muitas coisas, mas tem um problema fundamental: ele “alucina”. Inventa referências, distorce protocolos e pode apresentar informações médicas incorretas com uma confiança inabalável.

Deixa-me dar-te um exemplo real. Um doutorando em cardiologia usou o ChatGPT para criar um resumo de literatura sobre anticoagulantes. O resultado? O modelo “inventou” um estudo que não existe e atribuiu dosagens erradas a um medicamento específico. Se isto chegasse à versão final da tese, poderia ter consequências graves.

Como evitar:

- Usa a IA apenas para gerar rascunhos iniciais ou estruturas

- Verifica cada afirmação clínica com fontes primárias

- Nunca confies em referências geradas pela IA sem as confirmar em PubMed ou bases de dados indexadas

Para mais estratégias sobre como usar IA sem plágio, consulta o nosso guia dedicado.

Erro #2 — Ignorar as Diretrizes de Disclosure

Sabes qual é a política da tua universidade sobre IA? E a da revista onde queres publicar?

Se a resposta for “não tenho a certeza”, tens um problema. Em 2025, revistas como The Lancet, NEJM e BMJ exigem declaração explícita do uso de ferramentas de IA generativa. Omitir esta informação pode resultar em retração do artigo — mesmo após publicação.

📄 STM Association White Paper (2023): Orientações éticas e práticas para uso de IA generativa em comunicação científica.

Checklist de compliance que deves seguir:

- Consulta o regulamento da tua escola doutoral sobre IA

- Verifica as “Instructions for Authors” de cada revista-alvo

- Prepara uma declaração padrão que podes adaptar a cada submissão

- Documenta internamente como e onde usaste IA (para responder a questões futuras)

Erro #3 — Confiar na Paráfrase Automática

Tenho uma má notícia para ti: os detectores de plágio evoluíram. E muito.

Ferramentas básicas de paráfrase — aquelas que simplesmente substituem palavras por sinónimos — já não funcionam. Os sistemas modernos detectam padrões de reformulação artificial. E pior: em Medicina, parafrasear guidelines clínicas de forma superficial pode distorcer completamente o significado.

Pensa nisto: a diferença entre “o medicamento deve ser administrado” e “o medicamento pode ser administrado” é enorme em contexto clínico. Uma ferramenta de paráfrase automática não compreende estas nuances.

A alternativa correta:

- Lê e compreende profundamente o conteúdo original

- Reescreve com as tuas próprias palavras, mantendo a precisão

- Cita sempre as fontes originais, mesmo quando reformulas

- Usa ferramentas de verificação de originalidade como complemento, não como solução

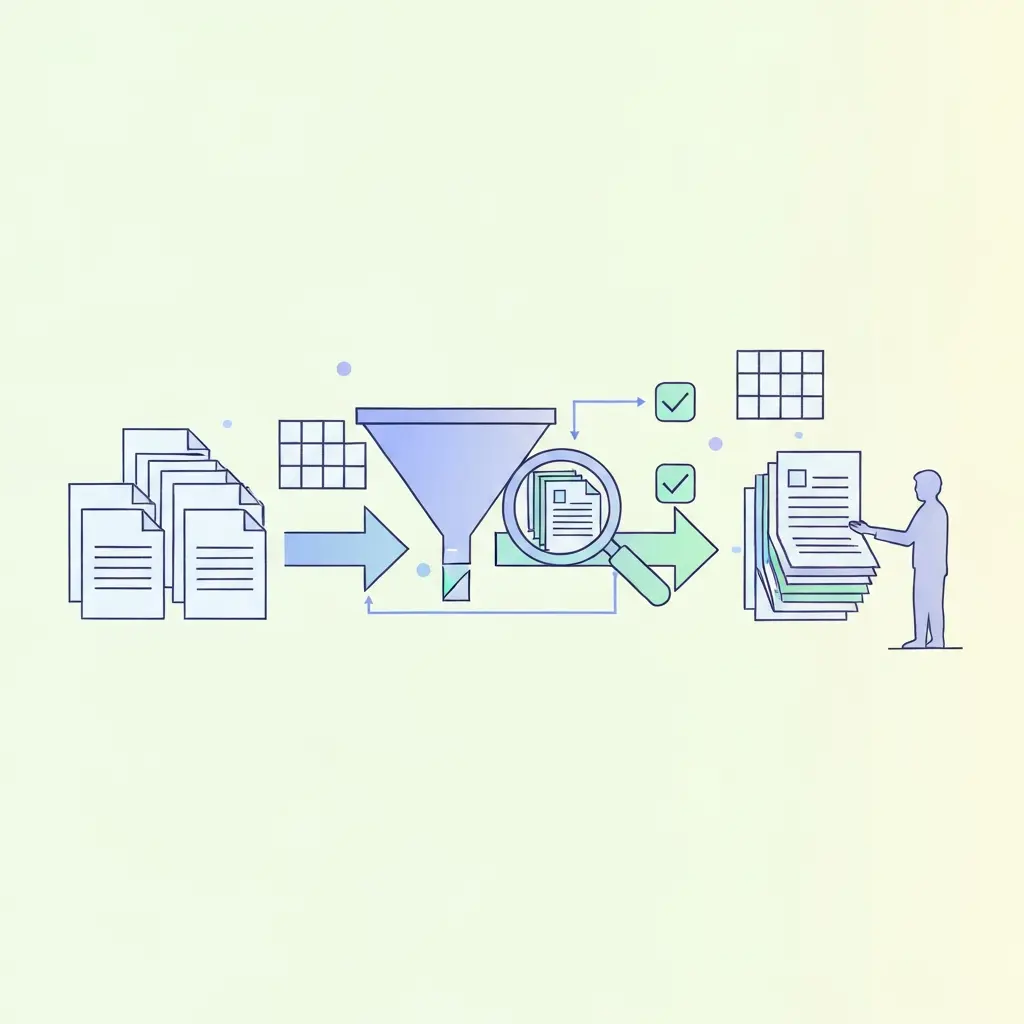

Erro #4 — Usar IA em Revisões Sistemáticas Sem Validação

As revisões sistemáticas são o “gold standard” da evidência em Medicina. Um erro aqui não é apenas embaraçoso — pode invalidar toda a tua investigação.

O problema com usar IA genérica para revisões sistemáticas é duplo: ela pode omitir estudos relevantes (porque não tem acesso a todas as bases de dados) e pode incluir estudos retratados (porque não verifica o estado atual das publicações).

Felizmente, existem ferramentas especializadas que fazem isto de forma muito mais segura:

🔬 Elicit — Workflow de triagem e extração com citações diretas do PDF. Ver guia de revisões sistemáticas →

🐰 ResearchRabbit — Descoberta de literatura e mapeamento de autores. Explorar ferramenta →

Aqui tens um tutorial prático sobre como automatizar revisões sistemáticas com Elicit:

A regra de ouro: Usa estas ferramentas para acelerar a triagem inicial, mas valida sempre manualmente antes de incluir qualquer estudo na tua revisão.

Erro #5 — Linguagem Científica Inadequada

A IA generativa produz texto “genérico”. E em Medicina, isto é um problema sério.

Deixa-me dar-te exemplos concretos de confusões terminológicas que vejo frequentemente:

- “Eficácia” vs. “Efetividade” — Eficácia refere-se a condições controladas (ensaios clínicos); efetividade aplica-se ao mundo real

- “Sensibilidade” vs. “Especificidade” — Conceitos distintos em diagnóstico que não são intermutáveis

- “Incidência” vs. “Prevalência” — Medidas epidemiológicas com significados completamente diferentes

Quando o ChatGPT usa estes termos de forma incorreta ou intercambiável, o resultado pode ser cientificamente inválido.

Soluções práticas:

- Cria prompts com terminologia MeSH específica

- Revisa sempre o output com um colega ou orientador

- Usa glossários médicos como referência durante a edição

- Considera ferramentas específicas para escrita académica como Writefull

Para conheceres mais opções de ferramentas de IA para escrita de teses, consulta o nosso guia atualizado.

Erro #6 — Expor Dados de Pacientes

Este erro pode ter consequências legais graves. Não estou a exagerar.

⚠️ Alerta RGPD: Inserir dados clínicos em ferramentas de IA públicas pode constituir violação de dados pessoais, com consequências legais e éticas graves — incluindo multas significativas e expulsão de programas doutorais.

Ferramentas como ChatGPT, Claude ou Gemini na versão gratuita não são seguras para dados de pacientes. Mesmo que penses que anonimizaste os dados, estudos demonstram que informação demográfica combinada pode permitir reidentificação.

O que deves fazer:

- Nunca insiras dados identificáveis em ferramentas de IA públicas

- Se precisas de usar IA com dados, opta por versões enterprise com compliance HIPAA/RGPD

- Consulta o Data Protection Officer da tua instituição antes de usar qualquer ferramenta nova

- Considera trabalhar com dados completamente sintéticos para testar prompts

Erro #7 — Dispensar a Orientação Humana

Este é talvez o erro mais subtil — e o mais autodestrutivo.

Sim, a IA pode gerar texto. Sim, pode ajudar-te a estruturar argumentos. Mas a supervisão do teu orientador continua essencial. Porquê? Porque a IA não compreende as nuances metodológicas específicas da tua área.

A diferença entre um ensaio clínico randomizado e um estudo observacional retrospetivo não é apenas técnica — implica abordagens completamente diferentes à análise e interpretação. A IA não vai questionar as tuas escolhas metodológicas. O teu orientador vai — e é isso que te faz crescer como investigador.

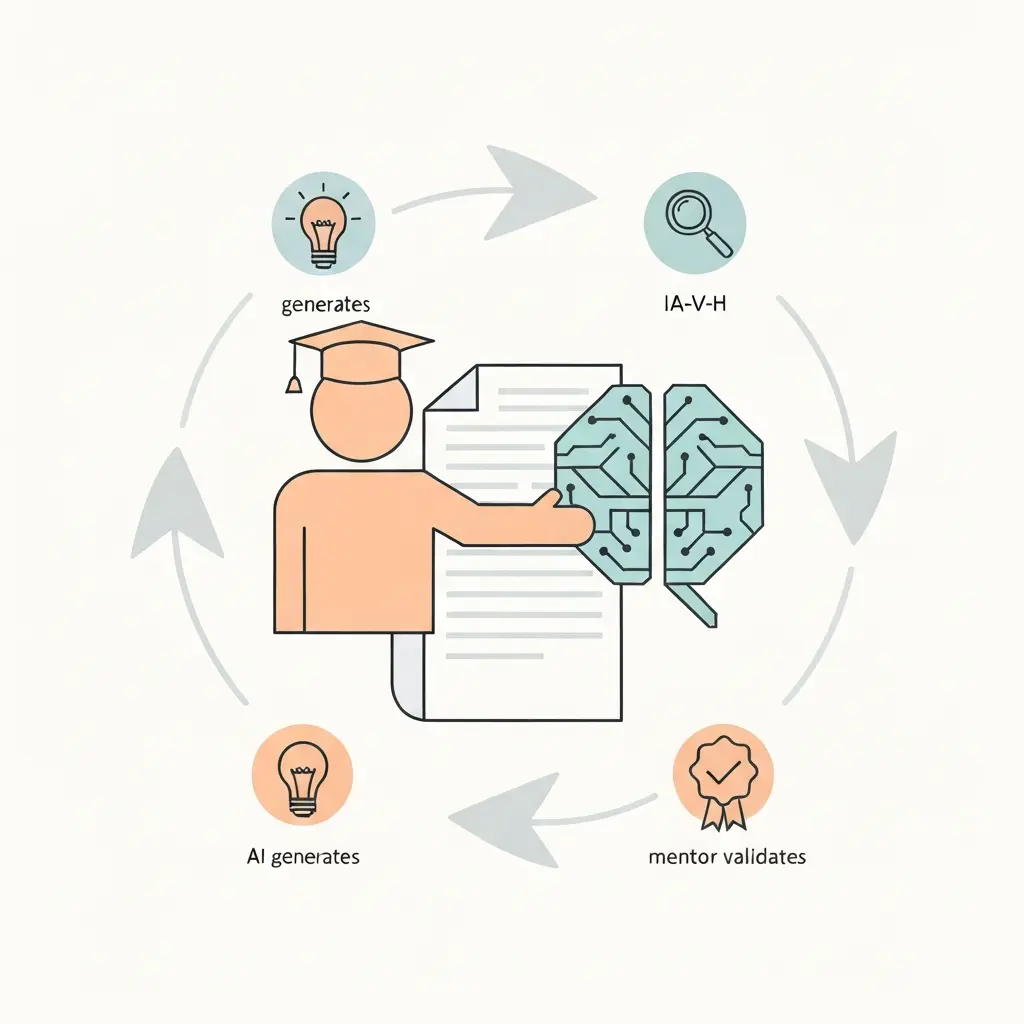

O princípio que deves seguir: Usa a IA como assistente, nunca como autor. Ela gera, tu verificas, o humano valida.

Aprofunda este tema no nosso artigo sobre erros fatais ao usar IA em teses.

O Que Diferencia os Doutorandos de Sucesso

Depois de analisar dezenas de casos, identifiquei um padrão claro. Os doutorandos que usam IA de forma eficaz seguem um método que chamo de “IA-V-H”:

- IA gera — O primeiro rascunho, a estrutura, as ideias iniciais

- Verificas — Confirmas cada facto, cada referência, cada termo técnico

- Humano valida — O orientador ou revisor dá feedback final

Este ciclo parece simples, mas requer disciplina. E os resultados são impressionantes.

Uma doutoranda em oncologia que conheço usou Elicit combinado com ResearchRabbit para a sua revisão de literatura. O resultado? Poupou cerca de 40 horas na fase de triagem — tempo que redirecionou para análise crítica e escrita original. Mas — e isto é crucial — ela validou manualmente cada artigo incluído na revisão final.

| Fase da Tese | ❌ Erro Comum | ✅ Boa Prática |

|---|---|---|

| Revisão de literatura | Copiar resumos do ChatGPT | Usar Elicit para extrair citações verificáveis |

| Escrita | Gerar parágrafos inteiros | Criar outlines e expandir manualmente |

| Dados | Inserir dados de pacientes | Usar apenas dados anonimizados em ferramentas seguras |

| Revisão | Confiar cegamente na paráfrase | Reescrever com compreensão + citação |

O Que Esperar em 2025 e Além

O panorama está a evoluir rapidamente. Eis o que podes esperar nos próximos meses:

Ferramentas especializadas em ascensão: Plataformas como Consensus (que sintetiza evidência científica) e Scite (que mostra como artigos são citados — de forma apoiante ou contrastante) estão a ganhar terreno entre investigadores médicos.

Integração com gestores de referências: Zotero já tem plugins que incorporam IA para sugestões de citação e organização. Esta tendência vai intensificar-se.

“AI literacy” como competência obrigatória: Algumas escolas doutorais europeias já estão a incluir formação específica sobre uso ético de IA nos seus programas. Portugal deve seguir este caminho.

Previsão para Portugal: Espero que até ao final de 2025, as principais universidades portuguesas tenham guidelines formais sobre o uso de IA em teses de doutoramento.

Olhando para 2025-2027, vejo três desenvolvimentos principais: consolidação de guidelines institucionais, emergência de ferramentas “médico-específicas” com validação por especialistas, e possível integração em defesas de tese com assistentes de IA para preparação de respostas.

O meu conselho? Investir agora em literacia de IA é investir na tua carreira. Os investigadores que dominarem estas ferramentas de forma ética e eficaz terão uma vantagem competitiva significativa.

Próximo Passo — Protege a Tua Tese

Vamos recapitular. Os 7 erros que deves evitar são:

- ✅ Não gerar texto clínico sem verificação rigorosa

- ✅ Conhecer e seguir as diretrizes de disclosure

- ✅ Não confiar em paráfrase automática

- ✅ Validar sempre as fontes em revisões sistemáticas

- ✅ Adaptar a linguagem à terminologia médica correta

- ✅ Proteger dados de pacientes absolutamente

- ✅ Manter sempre a orientação humana no processo

Se seguires estas diretrizes, a IA pode ser verdadeiramente a tua maior aliada no doutoramento.

Precisas de ajuda para estruturar a tua tese de Medicina com IA de forma ética e eficaz?

A Tesify ajuda-te a criar uma tese sólida, original e em conformidade com todas as diretrizes — com ferramentas inteligentes de estruturação, revisão e verificação de originalidade.

Perguntas Frequentes

Posso usar ChatGPT na minha tese de doutoramento em Medicina?

Sim, mas com limitações importantes. Deves usá-lo apenas como ferramenta de apoio (brainstorming, estruturação inicial), verificar sempre as informações geradas com fontes primárias, e declarar o uso conforme as diretrizes ICMJE e da tua universidade.

Quais são as melhores ferramentas de IA para teses de doutoramento em Medicina?

Para revisões de literatura, Elicit e ResearchRabbit são excelentes opções. Para escrita académica, ferramentas como Writefull (específico para contexto académico) são mais seguras que chatbots genéricos. A Tesify oferece um ambiente integrado para estruturação e revisão de teses.

A IA pode ser co-autora da minha tese?

Não. Segundo as diretrizes COPE e ICMJE, ferramentas de IA não podem ser listadas como autoras. A responsabilidade total pelo conteúdo é sempre do investigador humano.

Como devo declarar o uso de IA na minha tese?

Inclui uma secção de “Declaração de Uso de IA” ou adiciona esta informação na secção de metodologia. Especifica quais ferramentas utilizaste e para que fins (ex: “ChatGPT foi utilizado para gerar ideias iniciais de estrutura, que foram posteriormente desenvolvidas e verificadas pelo autor”).