Imagina o cenário: quatro anos de investigação exaustiva, noites sem dormir e sacrifícios pessoais incontáveis. Um doutorando português decide “polir” o capítulo de discussão usando o ChatGPT. Apenas algumas correções de estilo, pensou ele. Três semanas depois, recebe uma notificação formal da comissão de ética — suspeita de fraude académica.

Este não é um caso hipotético. É a realidade silenciosa que está a acontecer em universidades de todo o mundo, incluindo Portugal.

📊 Dados que vão surpreender-te: Em 2024, mais de 67% das universidades europeias implementaram sistemas de deteção de IA nos seus processos de avaliação. No entanto, estudos recentes indicam que até 26% dos textos sinalizados como “gerados por IA” são, na verdade, falsos positivos — textos escritos inteiramente por humanos.

Estás preparado para descobrir o que realmente acontece quando as ferramentas de IA para teses de doutoramento cruzam o caminho da integridade académica? O que vais ler nas próximas linhas pode mudar completamente a forma como abordas a escrita da tua tese.

O Que as Universidades Não Contam Sobre Ferramentas de IA

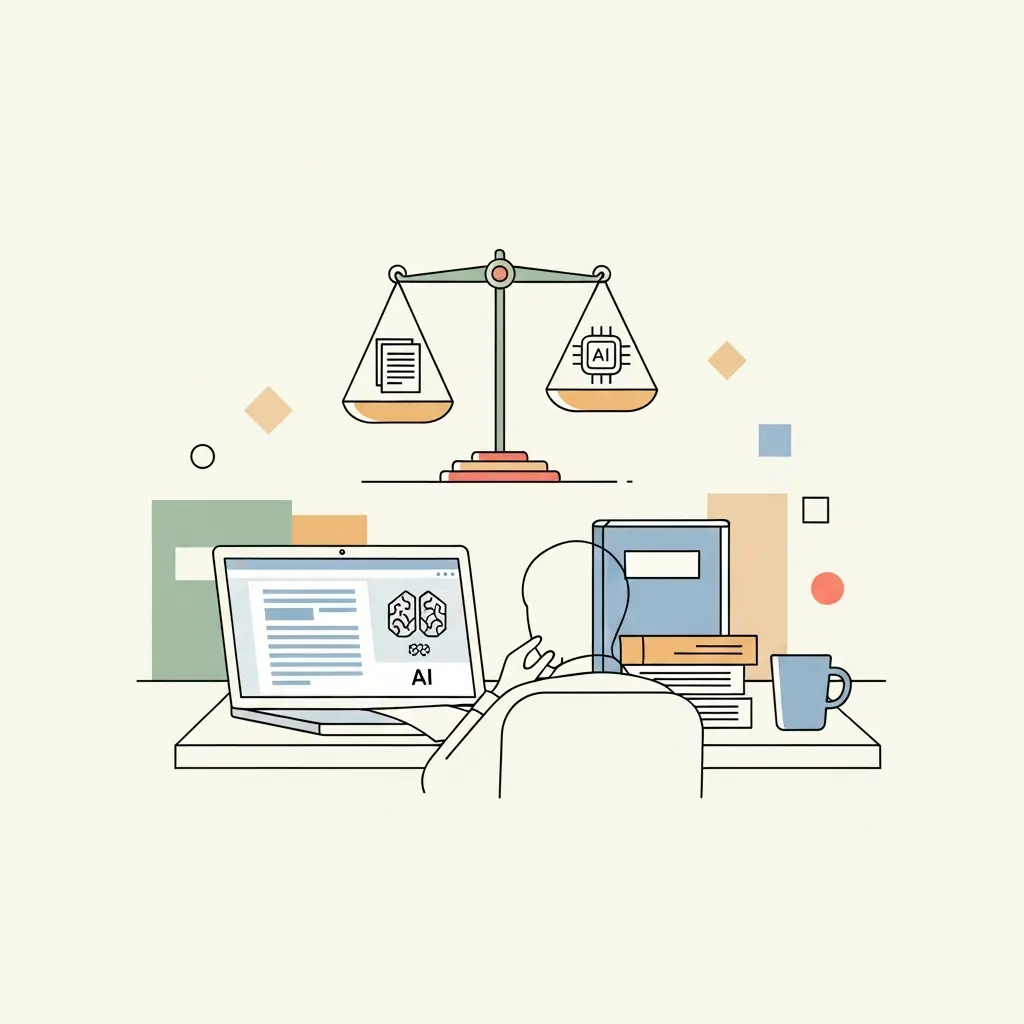

Existe um paradoxo fascinante — e perturbador — no mundo académico atual. Por um lado, orientadores e coordenadores de programa dizem-te: “Claro que podes usar IA para ajudar na tua escrita.” Por outro lado, ninguém te explica exatamente onde está a linha que separa o uso legítimo da infração académica.

O resultado? Um estado generalizado de paralisia, medo ou, pior ainda, uso ingénuo destas ferramentas.

Conheço pessoalmente dezenas de doutorandos que se encontram numa de três situações:

- Os paralisados: Têm tanto medo de serem apanhados que evitam qualquer contacto com IA, mesmo para tarefas completamente legítimas como verificação gramatical.

- Os ingénuos: Usam ChatGPT, Claude ou outras ferramentas sem qualquer precaução, partilhando capítulos inteiros e pedindo que “melhorem o texto”.

- Os invisíveis: Usam IA de forma estratégica, mas nunca falam sobre isso, criando uma cultura de secretismo que prejudica todos.

Neste artigo, vou revelar-te as verdades ocultas que orientadores raramente discutem e mostrar-te como usar ferramentas de IA de forma estratégica, ética e — acima de tudo — segura para a tua carreira académica.

Para um panorama mais abrangente sobre ferramentas de IA na escrita de teses, recomendo que consultes o nosso guia completo sobre verdades ocultas em 2025, que serve como fundação para tudo o que vamos explorar aqui.

Como Funcionam (Realmente) as Ferramentas de IA na Escrita Académica

Antes de mergulharmos nos riscos e estratégias, precisamos de estabelecer uma base sólida. Afinal, como é que estas ferramentas funcionam de verdade? E mais importante: o que é que elas não conseguem fazer, apesar do marketing impressionante?

Definição: Ferramentas de IA para teses de doutoramento são sistemas baseados em modelos de linguagem que auxiliam na escrita, revisão, paráfrase, organização bibliográfica e estruturação de texto académico. Incluem desde assistentes generalistas (ChatGPT, Claude) até soluções especializadas (Writefull, TeXGPT) integradas em editores como Overleaf.

Parece simples, certo? Mas esta definição esconde uma complexidade que a maioria dos utilizadores desconhece completamente.

Não é tudo igual. Entender as diferenças pode ser a barreira entre usar IA de forma inteligente e cometer um erro que te custa anos de trabalho.

| Categoria | Exemplos | Uso Legítimo | Risco Oculto |

|---|---|---|---|

| Assistentes de escrita | ChatGPT, Claude | Brainstorming, reformulação | Dependência, perda de voz autoral |

| Editores académicos | Writefull, Grammarly | Revisão linguística | Alteração de estilo académico |

| Gestão bibliográfica com IA | Beaver (Zotero), Elicit | Revisão de literatura | Alucinação de referências |

| Integrados em LaTeX | TeXGPT, AI Assist (Overleaf) | Correção de erros, formatação | Partilha de dados com terceiros |

📚 Recurso prático: Se usas Overleaf para a tua tese, conhece as funcionalidades de IA disponíveis e os seus limites de utilização — incluindo políticas de partilha de dados que podem afetar a confidencialidade da tua investigação.

Aqui chegamos ao ponto que quase ninguém explica aos doutorandos: os modelos de linguagem como o GPT-4, Claude ou Gemini não “compreendem” o que escrevem. São sistemas de previsão estatística extraordinariamente sofisticados. Analisam padrões em milhares de milhões de textos e preveem qual é a próxima palavra mais provável numa sequência.

Pensa nisso como um autocomplete extremamente avançado. Impressionante? Sem dúvida. Mas com uma consequência crítica para a tua tese:

- A IA não valida factos — pode gerar informação falsa com total confiança

- Não compreende metodologia — pode sugerir abordagens inadequadas para o teu campo

- Não conhece a tua investigação — generaliza quando deveria ser específica

A implicação é clara: independentemente de quanta ajuda recebas de ferramentas de IA, o doutorando continua a ser o único responsável por cada palavra, cada citação e cada conclusão da sua tese.

Este risco de originalidade é explorado em profundidade no artigo Ferramentas de IA Para Tese: O Que Ninguém Te Conta, que complementa perfeitamente o que estamos a discutir aqui.

O Estado Real do Uso de IA em Teses de Doutoramento em 2025

Agora que entendemos o que são estas ferramentas, vamos olhar para como estão realmente a ser usadas — e o que as instituições estão a fazer em resposta.

Se perguntares oficialmente aos doutorandos se usam IA na escrita das suas teses, vais obter uma resposta. Se perguntares de forma anónima, vais obter uma resposta completamente diferente.

Estudos recentes sugerem que:

- Entre 70-85% dos doutorandos já experimentaram alguma forma de IA generativa durante o seu percurso

- Apenas 23% declaram esse uso aos seus orientadores

- A discrepância é ainda maior em áreas como Ciências Sociais e Humanidades, onde o texto é o produto principal

A tendência de deteção e sanções está a crescer exponencialmente. Em 2024, várias universidades portuguesas reportaram aumentos superiores a 300% em casos formais de suspeita de uso indevido de IA.

As instituições estão a correr para criar políticas, mas a velocidade da tecnologia supera largamente a capacidade de resposta burocrática.

🌐 Diretrizes Internacionais: A UNESCO publicou orientações específicas sobre IA generativa em educação e investigação. Segundo o relatório atualizado em janeiro de 2026, as instituições devem estabelecer políticas claras de utilização, garantir transparência sobre quando e como a IA foi usada, proteger a privacidade dos dados dos estudantes e manter a responsabilidade humana final sobre o conteúdo.

Mas aqui está o problema: a maioria das universidades portuguesas ainda não adaptou completamente estas diretrizes aos seus regulamentos internos. O resultado é uma zona cinzenta perigosa onde cada caso é julgado de forma ad hoc.

Se a tua tese inclui artigos publicados ou se pretendes publicar capítulos em revistas científicas, há outro nível de complexidade a considerar. O ICMJE atualizou as suas recomendações em janeiro de 2024 para incluir declaração obrigatória do uso de IA em manuscritos. Embora focado em revistas médicas, este modelo está a ser adotado transversalmente.

Traduzindo: se usaste IA para ajudar a escrever um capítulo e depois o transformas em artigo científico, podes ter de declarar retroativamente esse uso — mesmo que a tua universidade não o exija para a tese.

Do outro lado da equação estão os sistemas de deteção. Os detetores de IA, como o Turnitin AI Detection ou o GPTZero, funcionam de forma semelhante aos próprios modelos de linguagem — analisam padrões estatísticos para determinar se um texto “parece” gerado por máquina.

O problema? Estes sistemas são imperfeitos.

🎥 Vídeo Recomendado: O Turnitin explica por que o seu próprio sistema pode identificar erroneamente texto humano como gerado por IA. Esta transparência é rara e importante para qualquer doutorando compreender. Ver vídeo e artigo completo →

Estudos independentes têm demonstrado que textos escritos por falantes não-nativos de inglês são desproporcionalmente sinalizados como “IA”, escrita académica muito formal ou técnica gera mais falsos positivos, e o português académico pode ser particularmente afetado devido a estruturas sintáticas distintas.

O que significa isto para ti? Que podes escrever toda a tua tese à mão, sem qualquer ajuda de IA, e ainda assim ser injustamente sinalizado. Uma perspetiva assustadora, não é?

5 Verdades Ocultas Que Podem Destruir a Tua Tese

Chegamos ao núcleo deste artigo — as verdades que ninguém te conta, mas que podem fazer a diferença entre um doutoramento bem-sucedido e anos de trabalho comprometidos.

As 5 verdades ocultas sobre IA em teses de doutoramento:

- Os teus dados podem estar a treinar modelos futuros

- Falsos positivos de deteção podem arruinar defesas

- A “voz autoral” perdida é irreversível

- Alucinações bibliográficas são indetectáveis a olho nu

- Políticas universitárias são ambíguas de propósito

Verdade #1: Os Teus Dados Não São Privados

Quando colas um capítulo da tua tese no ChatGPT gratuito, o que acontece a esse texto? A resposta pode surpreender-te: por defeito, nas versões gratuitas de muitos modelos de IA, o teu texto pode ser usado para treinar futuras versões do modelo. Isto significa que fragmentos da tua investigação original podem, teoricamente, aparecer em respostas dadas a outros utilizadores.

As diferenças entre planos são significativas. Versões gratuitas geralmente usam dados para treino (pode ser desativado nas definições). Versões pagas (Plus/Pro) têm políticas mais restritivas, mas variam por fornecedor. Versões Enterprise tipicamente não usam dados para treino, mas têm custo elevado.

Para investigação confidencial, proprietária ou patenteável, este risco é particularmente grave. Imagina descobrir, meses depois, que detalhes da tua metodologia inovadora estão a circular na internet através de respostas de IA a outros utilizadores.

Verdade #2: Detetores de IA Têm Taxas de Erro Preocupantes

Um estudo publicado em 2024 analisou a precisão de sete detetores de IA populares e encontrou taxas de falsos positivos que variavam entre 12% e 38%, dependendo do tipo de texto e da língua.

Para doutorandos que escrevem em português, os riscos são ainda maiores: modelos treinados predominantemente em inglês têm menor precisão noutras línguas, estruturas sintáticas típicas do português académico podem ser interpretadas como “padrões de IA”, e a tradução de conceitos técnicos cria padrões linguísticos atípicos que confundem os algoritmos.

Quando um júri de doutoramento recebe um relatório de deteção de IA com uma percentagem alta, raramente questiona a metodologia do detetor. O ónus de provar a inocência recai sobre o doutorando.

Verdade #3: Perder a Voz Autoral é Perder Anos de Trabalho

Este é talvez o risco mais subtil e, por isso, o mais perigoso. Ao longo de um doutoramento, desenvolve-se algo que orientadores experientes reconhecem imediatamente: uma voz autoral. É a forma única como argumentas, como conectas ideias, como expressas incerteza ou convicção.

Quando usas IA para “melhorar” ou “polir” extensivamente o teu texto, esta voz homogeneíza-se. O texto torna-se “genérico” — tecnicamente correto, mas sem personalidade. Os membros do júri de doutoramento lêem teses há décadas. Desenvolveram uma sensibilidade quase instintiva para detetar inconsistências de estilo.

Este risco é explorado com mais detalhe no artigo Ferramentas de IA Para Tese: O Que Ninguém Te Conta.

Verdade #4: Alucinações Bibliográficas São o Erro Mais Perigoso

Se há um conselho que precisas de gravar na tua memória, é este: nunca peças referências bibliográficas a uma IA generativa.

Os modelos de linguagem “alucinam” — inventam informação que parece perfeitamente plausível mas que simplesmente não existe. Quando se trata de referências académicas, estas alucinações são devastadoramente convincentes.

Imagina este cenário: pedes ao ChatGPT sugestões de artigos sobre o teu tema. Recebes uma lista com autores reais, títulos que soam académicos, e até DOIs formatados corretamente. Usas três dessas referências na tua tese. No dia da defesa, um membro do júri menciona que não conseguiu encontrar um dos artigos citados. Verificas — e descobres que não existe.

Isto já aconteceu em defesas reais. As consequências variam de humilhação pública a reprovação.

💡 Solução mais segura: Em vez de pedir à IA referências “do nada”, usa plugins como Beaver para Zotero que pesquisam apenas na tua própria biblioteca. A IA trabalha com fontes que já validaste — eliminando o risco de alucinação.

Verdade #5: A Ambiguidade Institucional Não É Acidental

Já reparaste como é difícil obter uma resposta clara e definitiva sobre o que é ou não permitido em termos de uso de IA na tua universidade? Isto não é incompetência administrativa. É, em muitos casos, uma estratégia deliberada.

As universidades evitam regras demasiado específicas por várias razões: flexibilidade para avaliar casos individuais, proteção legal que dificulta recursos de estudantes sancionados, e adaptação à evolução tecnológica rápida.

A consequência prática é que o ónus recai inteiramente sobre o doutorando. Se algo correr mal, a universidade pode sempre dizer: “Deveria ter perguntado. Deveria ter declarado. Deveria ter sido mais cuidadoso.”

Como te proteger? Documenta tudo. Guarda registos de todas as interações com IA. Se usares ferramentas de assistência, comunica proativamente ao teu orientador. Cria um rasto de papel que demonstre boa-fé.

Como Usar Ferramentas de IA Sem Riscos

Depois de tanta análise crítica, chegou o momento de transformar conhecimento em ação. Como é que podes realmente beneficiar das ferramentas de IA sem comprometer a tua integridade académica?

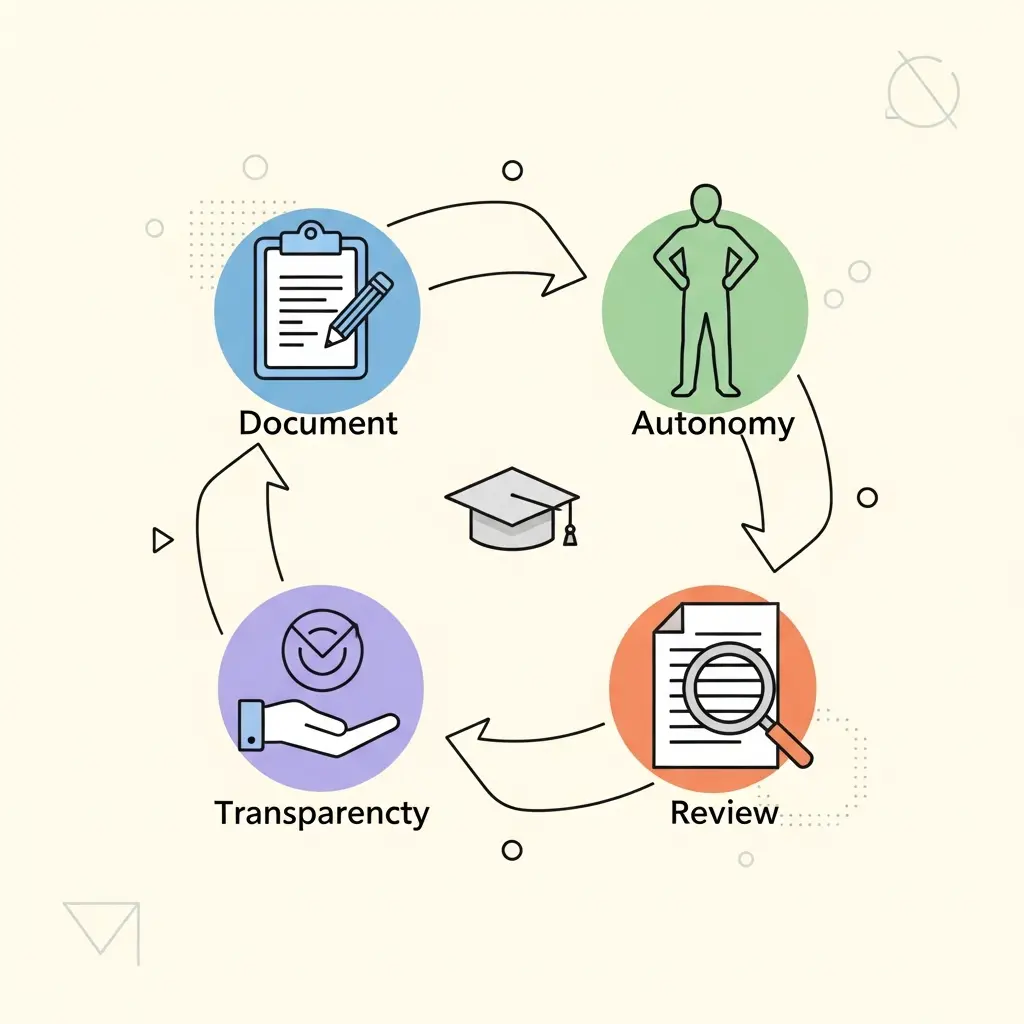

Desenvolvi este framework ao longo de anos de trabalho com doutorandos portugueses. É simples de memorizar e aplicável a qualquer situação:

Framework DART para IA em Teses:

- D – Documentar: Regista cada interação significativa com IA (prompt, resposta, como usaste)

- A – Autonomia: Mantém controlo absoluto sobre argumentação, metodologia e conclusões

- R – Revisão: Verifica 100% das saídas de IA — nunca confies cegamente

- T – Transparência: Declara uso conforme políticas da instituição (quando em dúvida, declara)

Este framework não é apenas sobre proteção — é sobre construir uma relação saudável e produtiva com estas ferramentas. A IA pode ser uma aliada poderosa no teu percurso de doutoramento, desde que saibas exatamente onde estão os limites.

O segredo está em usar a tecnologia como amplificador das tuas capacidades, nunca como substituto do teu pensamento crítico. A tua tese é o culminar de anos de dedicação e expertise. Nenhuma ferramenta, por mais avançada que seja, pode — ou deve — substituir isso.

Leave a Reply